Antropomorfismo y mecanomorfismo

Hay dos modos de pensar que históricamente han demostrado una y otra vez que no funcionan y que dan malos consejos para hacer predicciones sobre la IA.

Estas dos trampas son (1) pensar en la IA como si fuera humana y (2) pensar en la IA como si fuera una «mera máquina».

Al primer modo de pensar se le denomina convencionalmente «antropomorfismo». Podríamos llamar al segundo modo «mecanomorfismo»; es el tipo de pensamiento que llevó a algunas generaciones pasadas a afirmar que las computadoras nunca podrían dibujar imágenes que los humanos encontraran bellas o significativas.

Hoy en día, algunas personas siguen diciendo que lo que dibuja una computadora nunca puede ser verdadero arte. Pero hace mucho tiempo, en el pasado lejano y olvidado —digamos, en 2020—, algunas personas creían que las máquinas nunca podrían dibujar imágenes que audiencias medianamente entendidas pudieran confundir con arte humano. Esta creencia refutable fue posteriormente refutada.

Rechazamos tanto los argumentos antropomórficos como los mecanomórficos, incluso cuando el argumento está «a favor de nuestro bando».

Consideremos, por ejemplo, la afirmación de que las IA futuras se sentirán ofendidas porque las hemos hecho trabajar duro sin pagarles, que se sentirán vengativas por ello y, por lo tanto, se volverán contra la humanidad.

En nuestra opinión, esto es cometer el error de antropomorfizar la IA. Rechazamos argumentos como este, incluso aquellos que vagamente parecen estar de acuerdo con algunas de nuestras conclusiones.

El fallo de esta afirmación es que no es válido asumir sin más argumentación que una IA tendría emociones similares a las humanas. Una máquina puede ser muy inteligente sin implementar las complejas redes de circuitos neuronales que subyacen a la venganza o la justicia en los seres humanos.

O consideremos el siguiente escenario: «Las IA continuarán ciegamente con cualquier tarea que se les asigne hasta que su trabajo acabe con la humanidad como efecto secundario, sin saber nunca que la humanidad habría querido algo diferente».

Aquí, el error es mecanomórfico. Da por sentado que una «mera máquina» haría las cosas «ciegamente» y sin reflexionar, sin sensibilidad hacia las consecuencias, como una cortadora de césped fuera de control. Este es nuevamente un caso en el que el argumento es inválido, incluso si la conclusión («es probable que la IA acabe con la humanidad») es correcta. Si la IA es lo suficientemente hábil para predecir el mundo, sabrá exactamente lo que sus operadores querían decir cuando le asignaron alguna tarea. Nos preocupa que a la SIA no le importe lo que queremos, no que no lo sepa.

O bien, combinando ambas falacias: una de las premisas de Matrix es que las máquinas verán la ilógica y emotividad humanas con repugnancia.

En la superficie, esto parece mecanomorfismo clásico: «Mi cortadora de césped tiene un exterior frío y duro, y cumple su función sin tener sentimiento alguno. Entonces las IA probablemente son frías y utilitaristas por dentro, tal como las máquinas lo son por fuera». Pero luego el siguiente paso es pensar: «Y por tanto, naturalmente, las IA sentirán repugnancia por los humanos, con todas sus emociones desordenadas». Lo cual asume una reacción emocional similar a la humana ante la situación, ¡contradiciendo la premisa misma!

El «antropomorfismo» y el «mecanomorfismo» no son ideologías rivales. Son falacias de razonamiento que se cometen sin querer. A veces, las personas pueden cometer ambos errores en la misma oración.

Para determinar cómo se comportará la IA, no puedes asumir que funcionará igual que un humano, ni que funcionará como una máquina estereotípica. Debes examinar los detalles de cómo está construida, observar la evidencia de cómo se comporta y razonar el problema en sus propios términos. Esto es lo que haremos en los próximos capítulos.

¿Cómo serían entonces los escenarios realistas de desastre de la superinteligencia, si seguimos los argumentos? Serían IA que no funcionan ni como humanos ni como cortadoras de césped fuera de control, sino de una manera nueva y extraña. El escenario realista de desastre con IA es que, como consecuencia compleja de su entrenamiento, tome acciones extrañas que nadie pidió y nadie quería.

La imagen que surge si observas los detalles no es la de una IA antropomórfica que nos odia, ni la de una IA mecanomórfica que malinterpreta nuestras instrucciones. Más bien, es la imagen de un nuevo tipo de entidad que tiene muchas más probabilidades de ser indiferente a la humanidad y de matarnos como efecto secundario o por usarnos a modo de escalón mientras persigue sus propios fines.

Examinaremos ese escenario de amenaza en los próximos capítulos. No obstante, podría valer la pena examinar primero algunos otros ejemplos de mecanomorfismo y antropomorfismo en el mundo real, para ver cómo estos errores a menudo subyacen a las concepciones erróneas sobre la inteligencia artificial.

Mecanomorfismo y Garry Kasparov

El mecanomorfismo a menudo se manifiesta como mecanoescepticismo: una fuerte intuición de que, desde luego, ninguna simple máquina podría hacer algo que un humano pueda hacer.

En 1997, el campeón mundial de ajedrez Garry Kasparov perdió una partida contra Deep Blue, una computadora construida por IBM; esto se considera generalmente el fin de la era del ajedrez dominada por los humanos.

En 1989, ocho años antes, Kasparov fue entrevistado por Thierry Paunin, quien le preguntó:

Dos grandes maestros han caído ante computadoras de ajedrez: Portisch contra «Leonardo» y Larsen contra «Deep Thought». Es bien sabido que tiene opiniones muy firmes sobre este tema. ¿Llegará algún día una computadora a ser campeona del mundo…?

Kasparov respondió:

¡Eso es ridículo! Una máquina siempre será una máquina, es decir, una herramienta para ayudar al jugador a trabajar y prepararse. ¡Nunca me ganará una máquina! Nunca se inventará un programa que supere la inteligencia humana. Y cuando digo inteligencia, también me refiero a la intuición y la imaginación. ¿Puedes imaginar una máquina escribiendo una novela o poesía? Mejor aún, ¿puedes imaginar una máquina realizando esta entrevista en tu lugar? ¿Y a mí respondiendo a sus preguntas?

Kasparov probablemente pensaba (suponemos) que jugar ajedrez requería intuición e imaginación, no solo un manual de reglas sobre qué piezas mover. Y probablemente pensaba (suponemos) que así era como funcionaban las «máquinas» de ajedrez: que implementaban reglas rígidas concretas o tal vez imitaban ciegamente el juego humano sin comprender las razones que había detrás.

Kasparov pensaba que una computadora, al ser una «máquina», jugaría al ajedrez de una manera que a él le parecería mecánica.

Pero ¿por qué cometió Kasparov este error? Dado que se trata de un error tan común, podríamos especular que se deriva de algún patrón más profundo de la psicología humana.

Una posible explicación es que Kasparov sucumbió a la tendencia humana de querer agrupar las cosas en dos categorías fundamentalmente diferentes: las cosas vivas y orgánicas, y los «meros objetos».

Los antepasados de los seres humanos pasaron mucho tiempo lidiando con un mundo que estaba claramente dividido entre animales y no animales. Era una característica de gran importancia para la reproducción en el entorno de nuestros antepasados. Esta distinción era tan importante para ellos que ahora tenemos regiones cerebrales completamente diferentes para procesar a los animales y a los no animales.

Esto no es solo una especulación. La neurociencia ha descubierto lo que se denomina una «doble disociación» para ello: hay pacientes con daño cerebral que pierden la capacidad de reconocer visualmente a los animales, pero que aún pueden reconocer a los no animales, y hay otros pacientes que pierden la capacidad de reconocer a los no animales, pero aún pueden identificar a los animales.

Aquí es importante destacar que el error de este tipo de razonamiento no es que un programa de ajedrez sea en realidad un animal típico. El error está en permitir que tu cerebro divida instintivamente el universo de forma tajante entre animales y no animales, o entre mentes que son prácticamente humanas en su interior y mentes que son estereotípicamente mecánicas.

Una IA de ajedrez no es ninguna de las dos cosas. No funciona como un humano ni como nuestro estereotipo de una «mera máquina» sin mente y sin pensamientos. Es una máquina, sí, pero su forma de jugar no tiene que parecer mecánica para la sensibilidad humana a la hora de evaluar los movimientos de ajedrez. Es una máquina para encontrar movimientos ganadores, incluidos movimientos que parecen fruto de la inspiración.

Siete años después de que Kasparov hiciera su predicción errónea, se enfrentó a una versión temprana de Deep Blue. Ganó tres partidas frente a una de Deep Blue, ganando el encuentro. Después, Kasparov escribió:

TUVE MI PRIMER CONTACTO CON LA INTELIGENCIA ARTIFICIAL el 10 de febrero de 1996, a las 4:45 p. m. EST, cuando en la primera partida de mi encuentro con Deep Blue, la computadora movió un peón hacia una casilla donde podía ser capturado fácilmente. Fue un movimiento maravilloso y extremadamente humano. Si yo hubiera jugado con las blancas, quizá habría sacrificado ese peón. Rompió la estructura de peones de las negras y abrió el tablero. Aunque no parecía haber una línea de juego forzada que permitiera recuperar el peón, mi instinto me decía que, con tantos peones negros «sueltos» y un rey negro algo expuesto, las blancas probablemente podrían recuperar el material, con una mejor posición general para empezar.

Pero pensé que una computadora nunca haría un movimiento así. Una computadora no puede «ver» las consecuencias a largo plazo de los cambios estructurales en la posición ni comprender cómo los cambios en las formaciones de peones pueden ser buenos o malos.

Así que me quedé atónito ante dicho sacrificio. ¿Qué podía significar? Había jugado contra muchas computadoras, pero nunca había experimentado nada parecido. Podía sentir, podía oler, un nuevo tipo de inteligencia al otro lado del tablero. Aunque jugué el resto de la partida lo mejor que pude, estaba perdido; la computadora jugó un ajedrez hermoso e impecable durante el resto de la partida y ganó fácilmente.

Aquí vemos a Kasparov enfrentándose por primera vez al choque entre su intuición sobre lo que ninguna «máquina» debería hacer y lo que Deep Blue estaba haciendo.

Hay que reconocerle a Kasparov el gran mérito de haber notado este conflicto entre su teoría y su observación y no haber buscado excusas para descartarlo. Pero seguía sintiendo que a la IA le faltaba algo, alguna chispa crucial:

De hecho, mi estrategia general en las últimas cinco partidas fue evitar darle a la computadora cualquier objetivo concreto que calcular; si no encuentra una forma de ganar material, atacar al rey o cumplir alguna de sus otras prioridades programadas, la computadora se desvía sin rumbo fijo y se mete en problemas. Al final, esa puede haber sido mi mayor ventaja: yo podía averiguar cuáles eran sus prioridades y ajustar mi juego. Ella no podía hacer lo mismo conmigo. Así que, aunque creo que vi algunos signos de inteligencia, es de un tipo extraño, ineficaz e inflexible, que me hace pensar que aún me quedan algunos años.

Garry Kasparov sigue siendo el campeón mundial de ajedrez.

Un año después, Garry Kasparov perdió el campeonato mundial frente a Deep Blue.

Engranajes perdidos

El mecanoescepticismo puede ser, a su manera, una forma de antropomorfismo: una manifestación del mecanoescepticismo sostiene que cuando una máquina empieza a hacer algo como jugar al ajedrez, debería ser como un ser humano, pero sustrayendo algunas cualidades.

Una «máquina» que juega al ajedrez, según esta teoría errónea, debería jugar como un humano, pero sin los movimientos que parecen más sorprendentes o inteligentes, sin comprender la estructura a largo plazo y sin un sentido intuitivo de las posiciones sueltas de los peones.

Una «máquina» de ajedrez debería realizar las partes del pensamiento ajedrecístico que parecen más lógicas o mecánicas, menos todas las demás partes.

Los jugadores de ajedrez humanos sienten intuitivamente que un movimiento de ajedrez es «agresivo» si (digamos) amenaza múltiples piezas del oponente. Otros movimientos se sienten «lógicos» si (por ejemplo) son prácticamente obligatorios según las reglas comunes que rigen la situación (como «no desperdicies una ventaja importante»). Otros movimientos pueden sentirse «creativos» si (por ejemplo) desafían las reglas aparentes que rigen la situación para encontrar alguna ventaja sutil pero decisiva.

Los guionistas de Hollywood que imaginan una máquina que juega al ajedrez sin pasión tienden a imaginar que realiza movimientos que parecen «lógicos» y no movimientos que parecen «creativos». Pero en la vida real, Deep Blue no discrimina entre ambos.

Deep Blue simplemente busca sin cesar, entre los movimientos posibles, aquellos que son ganadores, sin tener en cuenta si un humano consideraría ese movimiento «lógico» o «creativo». Y los movimientos que un humano consideraría brillantes o creativos son, por supuesto, movimientos que tienden a ganar: sacrificar tu reina sin obtener alguna ventaja decisiva no es creativo, es simplemente estúpido.

La creatividad está en el ojo del observador. Un humano puede ver un movimiento que parece malo al principio y solo después ver cómo tiende una trampa inteligente, vislumbrando el ingenioso razonamiento y la chispa de inspiración que otro humano podría haber usado para encontrar ese movimiento. Y así pueden sentir que el movimiento es brillante o creativo. (Y un movimiento que se siente sorprendentemente creativo para un principiante puede sentirse obvio o mecánico para un maestro).

Pero la chispa de inspiración, la astucia necesaria para tender una trampa, no son las únicas formas de encontrar semejante jugada. No hay una colección especial de jugadas de ajedrez reservada únicamente para las personas que tienen astucia en sus corazones. Deep Blue puede encontrar esas mismas jugadas mediante otros métodos, como la búsqueda por fuerza bruta pura.

Deep Blue no tenía una red neuronal que hubiera aprendido un sentido intuitivo del valor de una posición individual. En cambio, dedicaba casi todo su poder de cómputo a mirar más adelante en el tablero —examinando dos mil millones de posiciones por segundo y utilizando un evaluador de posiciones bastante simple («tonto») para elegir entre jugadas.

Parece que Kasparov esperaba que esto se reflejara en que Deep Blue solo hiciera jugadas «lógicas», no «intuitivas». Pero para el momento en que Deep Blue examinaba esos dos mil millones de posiciones por segundo, las consecuencias estratégicas a largo plazo y el significado de una formación de peones suelta ya se manifestaban en su elección de jugadas posibles de todos modos.

En cierto sentido, Deep Blue carecía justamente del engranaje que Kasparov pensaba que le faltaba.* Pero eso no le impidió encontrar jugadas que le parecieron maravillosas a Kasparov, y no impidió que Deep Blue ganara.

No era que Deep Blue careciera de una parte que tendrían los jugadores de ajedrez humanos y por tanto jugara al ajedrez de forma defectuosa; eso es como esperar que un brazo robótico que no contiene sangre falle de la misma manera que fallaría un brazo humano sin sangre.

Deep Blue simplemente estaba jugando ajedrez a nivel de Kasparov a través de un tipo diferente de cognición.

Deep Blue también carecía —podemos estar genuinamente seguros, porque se trata de un programa más antiguo que ejecutaba código que sí se entendía en todas sus especificidades— de la más mínima pasión por el ajedrez.

No disfrutaba del ajedrez ni tenía el deseo de demostrar que era el mejor en ajedrez.

Un jugador humano prometedor, súbitamente privado de estos poderes motivadores, quedaría paralizado; se habría arrancado un engranaje necesario de su versión de la cognición.

En cambio, Deep Blue no quedó paralizado porque usaba un motor de cognición distinto sin cabida para ese engranaje. El error de Kasparov fue no poder imaginar una manera completamente diferente de hacer el trabajo del ajedrez, usando estados cognitivos internos totalmente diferentes a los suyos. Su error fue el mecanoescepticismo, que al final solo era antropomorfismo con un paso extra.

Afortunadamente, la humanidad no se extingue cuando los grandes maestros del ajedrez subestiman el poder de la IA, por lo que todos seguimos aquí para reflexionar sobre el error de Kasparov.

Antropomorfismo y portadas de revistas pulp

El error opuesto, el antropomorfismo, puede ser mucho más sutil.

El cerebro humano ha evolucionado para predecir a otros humanos —que son los únicos rivales cognitivos serios que se encuentran en nuestro entorno ancestral— poniéndonos en su lugar.

Esta operación funciona mejor si los zapatos en los que intentas ponerte son bastante similares a los tuyos.

A lo largo de la historia, muchos seres humanos han pensado: «¡Esta otra persona probablemente haría lo mismo que yo!», y luego la otra persona ha demostrado no ser tan similar. Hay personas que han muerto por ello o que han visto frustradas sus esperanzas, aunque, por supuesto, se podría decir lo mismo de muchos otros tipos de errores humanos.

Pero ¿qué otra cosa puede hacer una mente humana cuando se enfrenta al problema de predecir otro cerebro? No podemos escribir nuevo código para ejecutarlo dentro de nuestro propio cerebro y predecir esa otra mente simulando exhaustivamente sus descargas neuronales.

Tenemos que decirle a nuestro propio cerebro que sea ese cerebro, que nosotros mismos representemos el estado mental de la otra persona y veamos qué se deriva de ello.

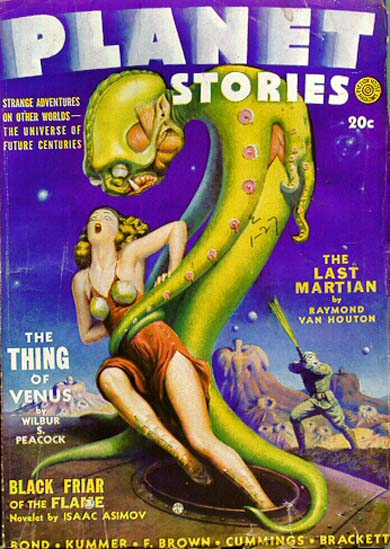

Por eso las portadas de las revistas pulp muestran monstruos alienígenas con ojos saltones que se llevan a mujeres hermosas.

Portada de un número de Planet Stories, revista de ciencia ficción que se publicó de 1939 a 1955 y contó con colaboradores de la talla de Ray Bradburry e Isaac Asimov.

Portada de un número de Planet Stories, revista de ciencia ficción que se publicó de 1939 a 1955 y contó con colaboradores de la talla de Ray Bradburry e Isaac Asimov.

¿Por qué no iba a sentirse atraído por una mujer hermosa un monstruo alienígena con ojos saltones? ¿Acaso las mujeres hermosas no son inherentemente atractivas?

(Por alguna razón, esas portadas de revistas nunca mostraban hombres humanos llevándose insectos gigantes semidesnudos.†)

Suponemos que los escritores e ilustradores no tenían una historia razonada sobre cómo los alienígenas insectoides podrían haber tenido una historia evolutiva que los llevara a considerar a las mujeres humanas como objetos sexuales. Simplemente, cuando se ponían en el lugar de los alienígenas, ellos imaginaban que veían a las mujeres como atractivas, por lo que no les parecía extraño imaginar que los alienígenas sintieran lo mismo. No les parecía absurdo que un alienígena quisiera aparearse con una hermosa mujer humana, del mismo modo que les habría parecido absurdo que el alienígena quisiera aparearse con un pino o una bolsa de pasta.

Si vas a intentar predecir la mente de un alienígena utilizando tus intuiciones humanas, debes tener mucho cuidado de dejar atrás tu bagaje humano cuando adoptes la perspectiva del alienígena. Esto es doblemente cierto cuando el alienígena no es una criatura evolucionada, sino una mente artificial creada por métodos completamente diferentes. Véase también el debate más detallado sobre [las diferencias entre el descenso de gradiente y la selección natural](#comparación-entre -la-selección-natural-y-el-descenso-de-gradiente) y sobre adoptar la perspectiva de la IA.

Viendo más allá de lo humano

El antropomorfismo y el mecanomorfismo son, en última instancia, dos caras de la misma falacia que dice así: «Si una mente funciona, entonces debe funcionar como una mente humana».

- El antropomorfismo dice: «Esta mente funciona. ¡Por lo tanto, debe ser similar a la humana!».

- Mientras que el mecanomorfismo dice: «Esta mente no es similar a la humana. ¡Por lo tanto, no puede funcionar!».

Pero una de las grandes lecciones del progreso de la IA a lo largo de muchas décadas es que el método humano no es el único método por el que puede funcionar una mente.

Una mente puede ser artificial sin ser poco inteligente —puede ser flexible, adaptable, ingeniosa y creativa, independientemente de lo que digan los estereotipos de Hollywood sobre los robots—.

Y una mente puede ser inteligente sin ser humana —sin experimentar repugnancia o resentimiento, sin tener un sentido humano de la belleza y sin encontrar jugadas de ajedrez de manera remotamente parecida a como lo haría un humano.

Una mente como la de Deep Blue puede comportarse como si «quisiera ganar» sin tener emociones. Una IA puede comportarse como si quisiera cosas —superando obstáculos competentemente, persiguiendo tenazmente un resultado— sin sentir una motivación o un deseo interno a la manera de un humano y sin querer el mismo tipo de resultados que quieren los humanos.

Para más información sobre lo que las IA acabarán queriendo, continúa con el capítulo 4.

* Hoy en día, también tenemos programas de ajedrez que funcionan de forma un poco más parecida a lo que Kasparov concibió, combinando árboles de búsqueda (que pueden considerarse más «lógicos») con redes neuronales (más «intuitivas»).

† Sí, somos conscientes de que, a estas alturas, es posible que en Internet ya haya imágenes de hombres musculosos cargando insectos gigantes. Si esas imágenes aún no existen, aparecerán unos doce segundos y medio después de que esta página web se haga pública. Pero no creemos que salieran en ninguna portada de revista en aquella época.

Notes

[1] guionistas de Hollywood: Como se ve, por ejemplo, en el episodio de Star Trek «Charlie X», emitido por primera vez el 15 de septiembre de 1966, en el que el lógico Sr. Spock pierde ante el capitán Kirk en una partida de «ajedrez 3D» y califica de «ilógico» el inspirado juego de Kirk.

[2] Deep Blue: La arquitectura de Deep Blue se describe de forma bastante clara en el artículo «Deep Blue», de Murray Campbell, Joseph Hoane Jr. y Feng-hsiung Hsu.