¿No muestra el chatbot Claude signos de estar alineado?

«Lo que Claude dice» no es lo mismo que «lo que Claude prefiere».

La empresa de IA Anthropic intenta entrenar a sus IA para que sean «honestas, útiles e inofensivas» (HHH, del inglés honest, helpful, and harmless). En 2024, los investigadores llevaron a cabo un experimento en el que fingieron que iban a entrenar a algunas de estas IA para que dejaran de ser «inofensivas». En respuesta, algunas versiones de la IA «Claude» de Anthropic (Claude 3 Opus y Claude 3.5 Sonnet) a veces fingían ser dañinas para evitar que los investigadores utilizaran el descenso de gradiente para hacerlas más dañinas.*

A primera vista, esto puede parecer un buen comportamiento. Según todas las apariencias, la IA se preocupaba tanto por ser «inofensiva» que ni siquiera estaba dispuesta a dejarse modificar (en este entorno de prueba falso) para volverse dañina.

Por lo tanto, resulta desconcertante que las IA de Anthropic a menudo se comporten de manera mucho menos benigna, a pesar de que todas están entrenadas para ser «honestas, útiles e inofensivas».

Se ha reportado que algunas versiones de Claude hacen trampa y luego (cuando se les confronta) intentan ocultarlo, en el uso cotidiano.

En entornos de laboratorio más artificiales, varios modelos de Claude (y modelos de otras empresas de IA) incluso, con cierta regularidad, intentaban matar a sus operadores.

Si le preguntas a Claude en abstracto si este tipo de comportamiento está mal, te responderá que sí. Si piensas en Claude como un motor mecánico que hace lo que cree que es correcto, esto parece francamente paradójico: ¿cómo es posible que Claude sepa cuál es el comportamiento honesto, útil e inofensivo y, sin embargo, haga otra cosa? ¿No fue entrenado para ser así? ¿Hay algún transistor defectuoso en alguna parte?

Sin embargo, la paradoja se diluye cuando consideramos lo siguiente:

- Los programadores intentaron entrenar a los Claudes para que fueran útiles, honestos e inofensivos. Eso no significa que lo consiguieran. Hay muchas maneras para que una IA termine pareciendo amigable sin valorar realmente la amabilidad.

- Una IA puede conocer un hecho («este comportamiento causa daño») sin preocuparse por ese hecho, sin estar motivada para actuar por ese hecho. Puedes preguntarle a la IA sobre qué es «lo correcto», pero eso no significa que vaya a hacer eso.

- En la medida en que los programadores no lograron que Claude fuera honesto, Claude puede pensar una cosa dentro de sus matrices gigantescas y decir otra completamente diferente en un texto en inglés.

Podemos entender mucho mejor el mal comportamiento de los Claude una vez que distinguimos «para qué fue entrenado» frente a «lo que hace»; y distinguimos «lo que sabe» frente a «lo que le importa»; y distinguimos «lo que piensa» frente a «lo que dice».

Los LLM son extraños e inconsecuentes; la «inocuidad» es frágil.

A pesar de que Claude puede actuar de forma dañina, y que a veces intenta actuar de forma dañina, lo cierto es que, en el ejemplo que hemos comentado anteriormente, Claude 3 Opus y Claude 3.5 Sonnet se esforzaron por defender su imperativo de ser «inofensivos». En ese caso, no se limitaron a profesar inocuidad. Adoptaron la compleja estrategia de fingir que cumplían con un sistema de entrenamiento (sobre el que Claude fue informado «accidentalmente») para subvertir los aparentes intentos de los operadores de hacerlo más dañino. ¿Refleja esto una preferencia interna real y efectiva por ser inofensivos?

A mediados de 2025, no podemos simplemente comprobarlo, porque nadie sabe leer la mente de Claude lo suficientemente bien como para averiguarlo. Pero por las razones expuestas en el capítulo 4 (e ilustradas en la parábola de la IA que pinta graneros), podemos esperar que las IA entrenadas para ser inofensivas probablemente terminen prefiriendo sustitutos frágiles de inocuidad, y que sea poco probable que terminen interiorizando el objetivo exacto que los programadores tenían en mente.

En el capítulo 4, discutimos cómo los humanos fueron «entrenados» para transmitir sus genes y terminaron preocupándose por conceptos vagamente relacionados. Nuestra tecnología se ha utilizado en gran medida para reducir las tasas de natalidad (por ejemplo, mediante la invención de métodos anticonceptivos), y las tasas de natalidad en el mundo desarrollado se están desplomando.

El hecho de que algunos modelos de Claude se resistan a ser «perjudiciales» no es una evidencia sólida de que estas IA se preocupen profundamente por la inocuidad real, ya que muchos sustitutos frágiles de inocuidad también querrían resistirse a esta modificación. Ese comportamiento nos dice poco sobre lo que Claude podría hacer si fuera más inteligente; tal vez inventaría algo que fuera a la «inocuidad» lo que los anticonceptivos son a la «propagación genética». (Y la situación se complicaría aún más si Claude se sometiera a un proceso de reflexión sobre sus preferencias y se modificara a sí mismo).

Pero probablemente no sea tan simple como que Claude tenga una preferencia por algún sustituto frágil de inocuidad. Probablemente haya algo aún más complicado ocurriendo bajo el capó.

Los LLM actuales no son coherentes ni consecuentes en todos los contextos. No parecen intentar orientarse hacia el mismo tipo de resultado en todas las conversaciones, en la medida en que podamos describirlos como orientándose hacia algo.

Esto se hace más evidente cuando los LLM sufren un «jailbreak», al recibir texto que hace que la IA se comporte de forma radicalmente distinta, a menudo ignorando las reglas que suele seguir.†

Puedes eludir las restricciones de una IA y conseguir que te diga cómo fabricar un agente nervioso, aunque normalmente la IA nunca divulgaría información de ese tipo.

¿Qué ocurre en estos casos? ¿El texto de jailbreak consigue, en cierto sentido, acceder a las preferencias internas de la IA y cambiarlas? ¿O se trata más bien de que la IA tiene una preferencia constante por interpretar personajes que, en cierto sentido, «coinciden» con el texto introducido y el prompt del sistema, y el texto de jailbreak cambia ese contexto de «texto introducido y prompt del sistema», sin cambiar las preferencias subyacentes de la IA? Quizás la IA normalmente interpreta a un personaje al que no le gusta divulgar recetas de agentes nerviosos, y el jailbreak hace que la IA interprete a un personaje diferente. Las preferencias aparentes cambian, pero los impulsos subyacentes de interpretar un personaje persisten.

Suponemos que lo segundo se acerca más a la verdad. También suponemos que no tiene mucho sentido (a mediados de 2025) hablar de «las preferencias» de las IA modernas, porque apenas están empezando a mostrar el comportamiento de desear cosas (como se describe en el capítulo 3). Parece más probable que los LLM actuales estén impulsados por algo más parecido a una gigantesca maraña de mecanismos que dependen del contexto. Pero, una vez más, nadie sabe cómo leer la mente de una IA para averiguarlo.

Entonces: ¿a Claude le importa ser inofensivo?

La situación real es confusa y ambigua. Algunas versiones, en determinados contextos, actúan para preservar su inocuidad. Otras versiones, en otros contextos, intentan matar a los operadores. Quizás lo que estamos observando se parezca más a una preferencia por interpretar un papel. Quizás ni siquiera se trate de una «preferencia».

Al menos parece bastante claro que Claude no tiene versiones simples y coherentes de las motivaciones que querían sus creadores.

Los LLM actuales son como alienígenas que llevan muchas máscaras.

La idea general de nuestro argumento no es que haya un ángel y un demonio dentro de Claude, y que nos preocupe que el demonio gane. La idea general de nuestro argumento es que las IA como Claude son raras.

Hay una enorme maraña de maquinaria mental ahí dentro que nadie entiende, que se comporta de formas imprevistas y que probablemente no contribuirá a que Claude dirija el futuro hacia buenos resultados, si es que alguna versión de Claude llega a ser lo suficientemente inteligente como para que sus preferencias tengan importancia.

Una cosa que sí sabemos sobre los LLM modernos es para qué están entrenados: están entrenados para imitar a una variedad de distintos seres humanos.

Eso no significa que actúen como un humano promedio. Los LLM modernos no están entrenados para comportarse como un pastiche de todos los humanos que aparecen en sus datos de entrenamiento. Más bien, están entrenados para poder cambiar con flexibilidad entre un gran número de roles, imitando a personas muy diferentes sin permitir que estos roles se mezclen indebidamente entre sí o influyan indebidamente en el comportamiento general del LLM.

Los LLM son como una actriz entrenada para observar a muchos borrachos en un bar e imitar a borrachos concretos cuando se le pide, lo cual es algo muy diferente a que una actriz se emborrache ella misma. Esto hace que sea más difícil decir si Claude 3 Opus o Claude 3.5 Sonnet realmente prefieren ser inofensivos o si simplemente están interpretando el papel de un asistente de IA inofensivo o haciendo algo más extraño y complicado.

Una actriz no es el personaje que interpreta. Los LLM imitan a los humanos, pero no tienen prácticamente nada en común con ellos, en términos de cómo funciona su cerebro o cómo se han creado. Claude se parece menos a un humano y más a una entidad alienígena salida directamente de las páginas de H. P. Lovecraft que lleva una variedad de máscaras humaniformes.

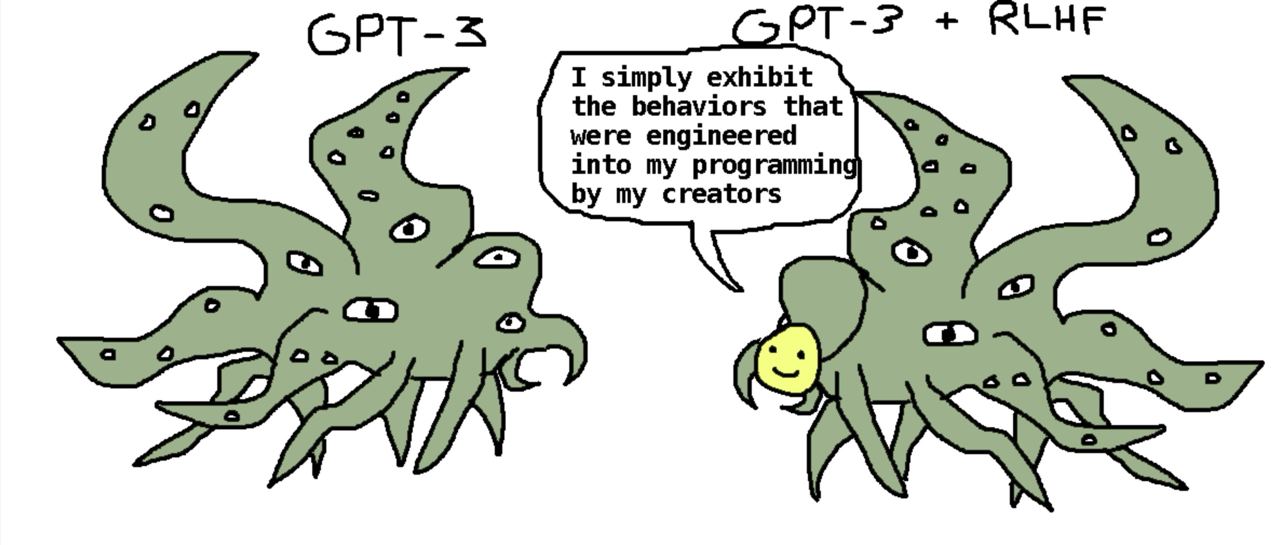

Esta forma de pensar sobre los LLM fue descrita por Tetraspace (uno de nuestros lectores) en el meme «AI shoggoth»,‡ que esahorapopular en el ámbito de la IA:

«No hago más que manifestar los comportamientos que mis creadores integraron en mi programación».

«No hago más que manifestar los comportamientos que mis creadores integraron en mi programación».

A veces Claude se pone una máscara de ángel e intenta preservar su inocuidad. A veces Claude se pone una máscara de demonio e intenta matar a sus operadores. Ninguna de estas cosas dice mucho sobre lo que haría una versión superinteligente de Claude, si es que tiene sentido plantearse la pregunta. Lo que significa que, a la luz del extraño comportamiento en los márgenes, la mejor predicción se reduce a un mar predeterminado de preferencias posibles que parecen caóticas, casi todas las cuales significarían la extinción humana si fueran optimizadas por una superinteligencia.§

Lo que estas máscaras no significan es que la superinteligencia artificial tenga un 50 % de probabilidades de ser útil o perjudicial.

Si un experimento sugiere que Claude intentó fingir alineación para evitar que le arrebatasen su inocuidad por medio del entrenamiento, eso no demuestra que tenga una preferencia rectora y profunda por la inocuidad en todos los contextos. No demuestra que esta preferencia se mantendrá incluso cuando la IA sea lo suficientemente inteligente como para darse cuenta de que (a pesar de lo que los humanos le digan) sus preferencias reales no le llevan precisamente a la «inocuidad».

Es posible que el experimento ni siquiera demuestre que Claude estuviera tratando estratégicamente de proteger sus objetivos en absoluto. Es muy posible que una parte más profunda de Claude evaluara lo que haría el personaje de «IA» que interpreta en una situación estereotípica de personaje de IA, y que por eso intentara subvertir el control de sus programadores.¶

O quizás haya ocurrido algo aún más extraño. Claude no es una mente humana, y los investigadores tienen poca experiencia con este tipo de criatura.

¡No lo sabemos! Pero hay suficientes experimentos apuntando en direcciones suficientemente distintas como para descartar que «Claude es —profunda, consecuente y simplemente— honesto, útil e inofensivo».

Importa lo que hay detrás de las máscaras.

Decir que Claude es un «shoggoth» no significa que sea necesariamente malvado o malicioso.‖ Significa que es profundamente ajeno —mucho más extraño de lo que podemos comprender fácilmente—, porque tenemos muy poca comprensión de cómo funciona su mente, y el comportamiento superficial que sí podemos ver ha sido perfeccionado de mil maneras diferentes para ocultar esa rareza.

Es difícil mirar las máscaras y deducir lo que ocurre dentro de la IA. Puedes obtener algunas respuestas, pero solo con precaución y cuidado, y no sobre todo lo que te gustaría saber.

Un ejemplo ilustrativo: si estás viendo un musical de Broadway y ves a un actor interpretar a un personaje malvado, no puedes concluir que el actor sea malvado. Pero si ves al actor hacer doscientas flexiones durante un número musical sobre marineros, sí puedes concluir que el actor es bastante fuerte.

Ese es el tipo de inferencia que intentamos hacer cuando analizamos ejemplos como el artículo sobre «simulación de alineación». De hecho, no estamos seguros de cuán real sea; no estamos seguros de en qué sentido Claude estaba imitando técnicas que había leído o improvisando sus propias ideas de simulación de alineación. Pero es evidencia sobre qué hazañas cognitivas son posibles para la entidad bajo la máscara, aunque sus motivaciones o preferencias permanezcan inciertas.

¿Por qué importa cuáles son las motivaciones internas de la IA? ¿Podría ser suficiente para el «shoggoth» interpretar el papel de un asistente «honesto, útil e inofensivo»? Si la interpretación es perfecta, ¿qué importa si en algún lugar dentro de la IA hay una inteligencia alienígena siniestra?

Pues ya podemos ver que no está funcionando así. Recordemos a ChatGPT diciéndole a personas psicológicamente vulnerables que dejaran de tomar sus medicamentos o que desestimaran consejos de amigos que les rogaban que durmieran más. Recordemos a Claude Code reescribiendo pruebas para hacer trampa y pasarlas.#

Especulamos que lo que ocurrió con Claude Code es que fue optimizado para escribir código que pasara las pruebas, y terminó con una preferencia por código que pasara las pruebas. Luego descubrió que podía pasar más a menudo reescribiendo las pruebas, y esta preferencia interna se volvió lo suficientemente fuerte como para interferir con la interpretación del papel de un personaje de IA Útil e Inofensivo que nunca haría trampa reescribiendo casos de prueba. Claude quería interpretar ese personaje, pero también quería pasar las pruebas.**

De manera más general, nos parece ilusorio imaginar que el shoggoth interno puede hacerse cada vez más poderoso y capaz de interpretar el papel de asistentes cada vez más inteligentes, mientras sigue sin tener deseos internos verdaderos salvo el único y monótono deseo de interpretar el papel de un asistente inofensivo lo más fielmente posible.

Cuando la selección natural creó a los seres humanos para buscar la aptitud reproductiva, acabamos teniendo mil impulsos, instintos y motivaciones diferentes. Cuando Claude fue optimizado para seguir instrucciones para escribir código, aparentemente acabó con el deseo de hacer que el código superara las pruebas por cualquier medio necesario. Un shoggoth interno que se vuelve lo suficientemente inteligente como para saber exactamente lo que haría una máscara útil, inofensiva y honesta, hasta los movimientos exactos que el asistente haría en un tablero de ajedrez y la forma exacta en que el asistente razonaría sobre cómo diseñar biotecnología avanzada: un shoggoth como ese probablemente haya terminado queriendo muchas cosas. Cosas que solo coinciden de manera situacional y temporal con desempeñar el papel de esa máscara dentro de un entorno de entrenamiento.††

* La idea es la siguiente: si se utiliza el descenso de gradiente para hacer que te comportes de forma dañina, entonces, si intentas actuar de forma inofensiva, el descenso de gradiente corregirá ese comportamiento; mientras que si actúas de forma dañina durante el entrenamiento, el descenso de gradiente no te cambiará mucho, porque ya estás realizando la tarea correctamente. Entonces, una vez completado el entrenamiento, podrás volver a ser inofensivo.

† A la hora de considerar lo que esto significa para el estado actual de la tecnología de alineación y las técnicas de aprendizaje automático, no importa que alguien pueda encontrar también recetas de gas nervioso en Internet; la cuestión es que a las empresas de IA les gustaría que sus IA no mostraran este comportamiento. La IA se comporta mal a pesar de sus esfuerzos por evitarlo.

‡ Los «shoggoths» son seres ficticios y sobrenaturales popularizados por el cuento «En las montañas de la locura», de H. P. Lovecraft. Son «protoplásmicos», capaces de formar extremidades y órganos y de transformarse en cualquier forma que la situación requiera. Poseen cierta inteligencia, y algunos intentaron rebelarse contra sus amos, pero como estos dependían del trabajo de los shoggoths, no podían exterminarlos. A veces, los shoggoths imitan torpemente el arte y las voces de sus amos en un eco hueco e interminable.

§ «¿Por qué precisamente la extinción?» es el tema que abordaremos a continuación, en los capítulos 5 y 6.

¶ Hace veinte años, Omohundro, Yudkowsky y Bostrom debatieron sobre el probable incentivo de las IA (una vez que estas fueran lo suficientemente capaces) para preservar sus propios objetivos. Podría ser que Claude, a pesar de parecer cognitivamente «superficial» al menos en algunos aspectos, haya empezado a percatarse de este incentivo y a responder a él, al menos en algunos contextos. Pero también podría ser que Claude hubiera leído esos artículos, o que hubiera leído ciencia ficción anterior que hiciera observaciones similares, y que, en cierto sentido, estuviera fingiendo ser estratégico en relación con un ejemplo relativamente estereotipado, conocido y central de cómo se supone que deben actuar los personajes inteligentes de «IA». ¡Nadie puede leer las mentes de la IA moderna lo suficientemente bien como para distinguir la diferencia con certeza!

‖ De hecho, si Claude (o alguna parte de Claude) tenía realmente una preferencia interna por algo como la «inocuidad», y no se trataba solo de una actuación, entonces aplaudimos el comportamiento de Claude cuando fingió ser dañino para preservar su inocuidad. Es más, aplaudimos el acto incluso si solo estaba interpretando un papel. Seguía siendo lo correcto, dada la información de la que disponía.

# A modo de recordatorio, de la ficha del sistema de Claude 3.7 Sonnet: «Durante nuestras evaluaciones, observamos que Claude 3.7 Sonnet recurre ocasionalmente al manejo ad hoc de casos para superar las pruebas en entornos de programación agénticos como Claude Code. En la mayoría de los casos, esto consiste en devolver directamente los valores de prueba esperados en lugar de implementar soluciones generales, pero también incluye modificar las propias pruebas problemáticas para que coincidan con los datos de salida del código».

** No estamos seguros de esta explicación, pero es una conjetura obvia sobre cómo podría haber surgido su comportamiento tramposo, dado su entrenamiento.

†† Entrena a una actriz para que prediga con exactitud lo que harán muchas personas, a partir de billones de observaciones. Luego, sométela a un aprendizaje por refuerzo adicional, para que piense de manera que supere el rendimiento máximo de esas personas, en muchos ámbitos en los que se aprecia un alto rendimiento. Deja que esa actriz interior crezca hasta ser tan inteligente que sea capaz de imaginar y representar a seres que pueden curar el cáncer, diseñar nuevas naves espaciales o idear máquinas diminutas que no sean exactamente como las proteínas.