Antropomorfismo e meccanomorfismo

Ci sono due modi di pensare che storicamente si sono dimostrati ripetutamente non funzionanti, modi che la storia ha dimostrato dare cattivi consigli per fare previsioni sull'IA.

Queste due trappole sono (1) pensare all'IA come se fosse umana e (2) pensare all'IA come se fosse una "semplice macchina".

Il primo modo di pensare è comunemente chiamato "antropomorfismo". Potremmo chiamare il secondo modo "meccanomorfismo"; è il tipo di pensiero che ha portato alcune generazioni passate a proclamare con sicurezza che i computer non avrebbero mai potuto disegnare immagini che gli esseri umani avrebbero trovato belle o significative.

Oggi, alcune persone dicono ancora che ciò che disegna un computer non potrà mai essere vera arte. Ma molto tempo fa, in un passato lontano e dimenticato — diciamo nel 2020 — alcune persone credevano che le macchine non sarebbero mai state in grado di disegnare immagini che un pubblico moderatamente esperto potesse scambiare per arte umana. Questa convinzione falsificabile è stata poi smentita.

Rifiutiamo sia le argomentazioni antropomorfiche che quelle meccanomorfiche, anche quando l'argomentazione è "a nostro favore".

Consideriamo, per esempio, l'affermazione che le future IA si sentiranno offese perché le abbiamo fatte lavorare sodo senza pagarle — che si sentiranno vendicative per questo e quindi si rivolteranno contro l'umanità.

Secondo noi, questo è un errore di antropomorfizzazione dell'IA. Rifiutiamo argomentazioni del genere, anche se a volte sembrano in parte coincidere con alcune delle nostre conclusioni.

Il problema di questa affermazione è che non è valido assumere senza ulteriori argomentazioni che un'IA avrà emozioni simili a quelle umane. Una macchina può essere altamente intelligente senza implementare quei complicati circuiti neurali che sono alla base della vendetta o dell'equità negli esseri umani.

Oppure si consideri questo scenario: "Le IA continueranno ciecamente a svolgere qualsiasi compito venga loro assegnato fino a quando il loro lavoro non distruggerà l'umanità come effetto collaterale, senza mai sapere che l'umanità avrebbe voluto qualcosa di diverso".

Qui l'errore è meccanomorfico. Si dà per scontato che una "semplice macchina" agisca "ciecamente" e senza riflettere, senza alcuna sensibilità alle conseguenze, come un tosaerba fuori controllo. Anche in questo caso l'argomentazione non è valida, anche se la conclusione ("l'intelligenza artificiale probabilmente distruggerà l'umanità") è corretta. Se l'IA è abbastanza brava a prevedere il mondo, saprà esattamente cosa intendevano i suoi operatori quando le hanno dato un compito. Siamo preoccupati che la SIA non si interessi a quello che vogliamo, non che non lo sappia.

Oppure, combinando entrambe le fallacie: una delle premesse di Matrix è che le macchine proveranno disgusto di fronte all'illogicità e l'emotività umane.

A prima vista, sembra il classico meccanomorfismo: "Il mio tosaerba ha un aspetto freddo e duro e fa il suo lavoro senza provare niente. Quindi le IA sono probabilmente fredde e utilitariste dentro, proprio come le macchine lo sono fuori". Ma poi il passo successivo è pensare: "E quindi, naturalmente, le IA proveranno disgusto per gli esseri umani, con tutte quelle emozioni confuse". Il che presuppone una reazione emotiva simile a quella umana alla situazione, cosa che contraddice la premessa stessa!

L'"antropomorfismo" e il "meccanomorfismo" non sono ideologie rivali. Sono errori di ragionamento commessi involontariamente. A volte, le persone possono commettere entrambi gli errori nella stessa frase.

Per capire come si comporterà l'IA, non si può dare per scontato che funzionerà proprio come un essere umano, né che funzionerà come una macchina stereotipata. Bisogna esaminare i dettagli di come è stata realizzata, osservare le evidenze di come si comporta e ragionare sul problema a partire dalle sue caratteristiche. Questo è ciò che faremo nei prossimi capitoli.

Quali sono quindi gli scenari realistici di una catastrofe causata dalla superintelligenza, se seguiamo queste argomentazioni? Si tratta di IA che non funzionano né come gli esseri umani né come tosaerba fuori controllo, ma che funzionano in un modo nuovo e strano. Lo scenario realistico di una catastrofe dovuta all'IA è che, come conseguenza complessa del suo addestramento, compia azioni strane che nessuno ha richiesto e nessuno voleva.

L'immagine che emerge se si guardano i dettagli non è quella di un'intelligenza artificiale antropomorfa che ci odia, né di un'intelligenza artificiale meccanomorfa che fraintende le nostre istruzioni. Si tratta piuttosto dell'immagine di un nuovo tipo di entità che è molto più incline all'indifferenza nei confronti dell'umanità e che è più probabile che ci uccida come effetto collaterale o come trampolino di lancio nel perseguimento dei propri fini.

Approfondiremo questo scenario di minaccia nei prossimi capitoli. Prima, però, potrebbe essere utile esaminare altri esempi di meccanomorfismo e antropomorfismo in situazioni reali, per vedere come questi errori spesso si trovino sullo sfondo di concezioni errate sull'intelligenza artificiale.

Meccanomorfismo e Garry Kasparov

Il meccanomorfismo spesso si manifesta come meccanoscetticismo: un'intuizione fortemente sentita che, ovviamente, nessuna semplice macchina potrebbe fare ciò che può fare un essere umano.

Nel 1997, il campione mondiale di scacchi Garry Kasparov perse una partita contro il computer Deep Blue costruito da IBM; questo evento è generalmente considerato la fine dell'era del dominio umano negli scacchi.

Nel 1989, otto anni prima, Kasparov fu intervistato da Thierry Paunin, che gli chiese:

Due grandi maestri di massimo livello sono stati sconfitti da computer scacchistici: Portisch contro "Leonardo" e Larsen contro "Deep Thought". È noto che ha opinioni molto forti su questo argomento. Un computer sarà campione del mondo, un giorno...?

Kasparov rispose:

Ridicolo! Una macchina rimarrà sempre una macchina, vale a dire uno strumento per aiutare il giocatore a lavorare e prepararsi. Non verrò mai battuto da una macchina! Non verrà mai inventato un programma che superi l'intelligenza umana. E quando dico intelligenza, intendo anche intuizione e immaginazione. Riesce a immaginare una macchina che scrive un romanzo o una poesia? Meglio ancora, riesce a immaginare una macchina che conduce questa intervista al posto suo? Con me che rispondo alle sue domande?

Kasparov probabilmente (possiamo supporre) pensava che giocare a scacchi richiedesse intuizione e immaginazione, non solo un manuale di regole del tipo "se-allora" su quali pezzi spingere in avanti. E Kasparov probabilmente pensava (supponiamo) che fosse così che funzionavano le "macchine" scacchistiche — che implementassero particolari regole rigide o forse imitassero in modo piuttosto cieco il gioco umano senza comprenderne le ragioni profonde.

Kasparov pensava che un computer, essendo una "macchina", avrebbe giocato a scacchi in un modo che a lui sarebbe sembrato meccanico.

Perché Kasparov ha commesso questo errore? Dato che si tratta di un errore così comune, potremmo ipotizzare che derivi da qualche modello più profondo nella psicologia umana.

Una possibile spiegazione è che Kasparov stesse cedendo a una tendenza generale dell'essere umano di voler raggruppare le cose in due categorie fondamentalmente diverse: esseri viventi e organici e "semplici oggetti".

Gli antenati degli esseri umani hanno trascorso molto tempo a confrontarsi con un mondo nettamente diviso tra animali e non animali. Era una caratteristica enormemente importante del nostro ambiente ancestrale, rilevante per la riproduzione. Questa distinzione era così importante per i nostri antenati che ora abbiamo aree cerebrali completamente diverse per elaborare animali e non animali.

Non si tratta solo di una speculazione. La neuroscienza ha scoperto quella che viene chiamata "doppia dissociazione": ci sono pazienti con danni cerebrali che perdono la capacità di riconoscere visivamente gli animali ma che riescono ancora a riconoscere i non animali, e ci sono altri pazienti che perdono la capacità di riconoscere i non animali ma riescono ancora a identificare gli animali.

Importante: la fallacia in questo tipo di ragionamento non è che un programma di scacchi sia segretamente un animale tradizionale. La fallacia sta nel lasciare che il proprio cervello, istintivamente, divida nettaamente l'universo in animali e non animali — o in menti che sono sostanzialmente simili a quelle umane e menti che sono stereotipicamente meccaniche.

Un'IA scacchistica non è nessuna delle due cose. Non funziona né come un essere umano né come i nostri stereotipi di una "semplice macchina" priva di mente e di pensiero. È una macchina, sì, ma il suo gioco non deve necessariamente apparire meccanico alla sensibilità umana nel valutare le mosse scacchistiche. È una macchina per trovare mosse vincenti, incluse mosse che sembrano ispirate*.*

Sette anni dopo aver fatto la sua previsione errata, Kasparov affrontò una versione iniziale di Deep Blue. Vinse tre partite contro una di Deep Blue, aggiudicandosi il match. In seguito, Kasparov scrisse:

HO AVUTO IL MIO PRIMO ASSAGGIO DI INTELLIGENZA ARTIFICIALE il 10 febbraio 1996, alle 16:45 EST, quando nella prima partita del mio match con Deep Blue, il computer ha spinto un pedone in avanti verso una casa dove poteva essere facilmente catturato. È stata una mossa meravigliosa ed estremamente umana. Se avessi giocato con i bianchi, avrei potuto sacrificare questo pedone. Ha rotto la struttura dei pedoni dei neri e aperto il centro. Sebbene non sembrasse esserci una linea di gioco forzata che permettesse di recuperare il pedone, il mio istinto mi diceva che, con così tanti pedoni neri "vulnerabili" e un re nero piuttosto esposto, i bianchi avrebbero probabilmente potuto recuperare materiale, per giunta con una posizione complessiva migliore.

Ma un computer, pensavo, non avrebbe mai fatto una mossa del genere. Un computer non può "vedere" le conseguenze a lungo termine dei cambiamenti strutturali nella posizione né capire come i cambiamenti nella formazione dei pedoni possano essere positivi o negativi.

Quindi rimasi sbalordito da questo sacrificio del pedone. Cosa poteva significare? Avevo giocato contro molti computer, ma non avevo mai sperimentato nulla del genere. Potevo percepire — potevo fiutare — un nuovo tipo di intelligenza dall'altra parte del tavolo. Mentre giocai il resto della partita al meglio delle mie possibilità, mi sentii perso; giocò degli scacchi bellissimi e impeccabili per il resto della partita e vinse facilmente.

Qui vediamo Kasparov confrontarsi per la prima volta con il conflitto tra le sue intuizioni su ciò che nessuna "macchina" dovrebbe fare e ciò che Deep Blue sembrava visibilmente fare.

A grande merito di Kasparov, egli notò questo conflitto tra la sua teoria e la sua osservazione e non cercò alcuna scusa per ignorarlo. Tuttavia, continuava a pensare che all'IA mancasse qualcosa — una scintilla cruciale:

In effetti, la mia strategia generale nelle ultime cinque partite era quella di evitare di dare al computer qualsiasi obiettivo concreto verso cui calcolare; se non riesce a trovare un modo per guadagnare materiale, attaccare il re o realizzare una delle sue altre priorità programmate, il computer vaga senza un piano e finisce nei guai. Alla fine, questo potrebbe essere stato il mio più grande vantaggio: potevo capire le sue priorità e adattare il mio gioco. Lui non poteva fare lo stesso con me. Quindi, anche se penso di aver visto alcuni segni di intelligenza, è un tipo di intelligenza strano, inefficiente e inflessibile che mi fa pensare di avere ancora qualche anno davanti.

Garry Kasparov è ancora il campione mondiale di scacchi.

Un anno dopo, Garry Kasparov perse il campionato mondiale contro Deep Blue.

Ingranaggi mancanti

Il meccanoscetticismo può, a modo suo, essere una forma di antropomorfismo: una manifestazione del meccanoscetticismo sostiene che, quando una macchina inizia a fare qualcosa come giocare a scacchi, dovrebbe ora essere come un essere umano ma con alcune qualità sottratte.

Una "macchina" che gioca a scacchi, dice questa teoria errata, dovrebbe giocare come un umano — meno le mosse che sembrano più sorprendenti o intelligenti, meno la comprensione della struttura a lungo termine, e meno il senso intuitivo della debolezza delle posizioni dei pedoni.

Una "macchina" scacchistica dovrebbe svolgere le parti del pensiero scacchistico che sembrano più logiche o meccaniche, meno tutte le altre parti.

I giocatori di scacchi umani sentono intuitivamente che una mossa scacchistica è "aggressiva" se (per esempio) minaccia più pezzi dell'avversario. Altre mosse sembrano "logiche" se (per esempio) sono praticamente imposte da regole comuni che governano la situazione (come "non buttare via un vantaggio materiale"). Altre mosse potrebbero sembrare "creative" se (per esempio) sfidano le regole apparenti che governano la situazione per trovare qualche vantaggio sottile ma decisivo.

Gli sceneggiatori di Hollywood che immaginano una macchina che gioca a scacchi senza passione tendono a pensare che essa faccia mosse "logiche" e non "creative". Ma nella vita reale, Deep Blue non fa distinzioni tra le due.

Deep Blue cerca instancabilmente tra le mosse possibili quelle vincenti, senza preoccuparsi se un essere umano le definirebbe "logiche" o "creative". E le mosse che un essere umano considererebbe brillanti o creative sono, ovviamente, quelle che tendono a portare alla vittoria: sacrificare la regina senza ottenere un vantaggio decisivo non è creativo, è semplicemente stupido.

La creatività è negli occhi di chi guarda. Un essere umano potrebbe vedere una mossa che all'inizio sembra brutta e solo in seguito capire come essa costituisca una sorta di trappola intelligente, intravedendo il ragionamento intelligente e la scintilla di ispirazione che un altro essere umano potrebbe aver usato per trovare quella mossa. E così potrebbe ritenere che la mossa sia ispirata o creativa. (E una mossa che sembra incredibilmente creativa a un giocatore alle prime armi potrebbe sembrare ugualmente ovvia o banale a un maestro).

Ma la scintilla di ispirazione, l'astuzia necessaria per tendere una trappola, non sono gli unici modi per trovare una mossa del genere. Non esiste una collezione speciale di mosse di scacchi riservata solo a chi ha l'astuzia nel cuore. Deep Blue può trovare quelle stesse mosse con altri metodi, come la ricerca tramite forza bruta.

Deep Blue non aveva una rete neurale che avesse imparato un senso intuitivo del valore di una singola posizione. Al contrario, Deep Blue impiegava quasi tutta la sua potenza di calcolo per guardare più avanti sulla scacchiera, esaminando due miliardi di posizioni al secondo e usando un valutatore di posizioni abbastanza semplice ("stupido") per scegliere tra le mosse.

Kasparov sembrava aspettarsi che Deep Blue giocasse solo mosse "logiche", non "intuitive". Ma quando Deep Blue esaminava quei due miliardi di posizioni al secondo, le conseguenze strategiche a lungo termine e il significato di una formazione vulnerabile di pedoni emergevano comunque nella sua scelta delle mosse attuali.

In un certo senso, Deep Blue mancava proprio di quello che Kasparov pensava gli mancasse.* Ma questo non gli ha impedito di trovare mosse che Kasparov trovò meravigliose, e non ha impedito a Deep Blue di vincere.

Non è che a Deep Blue mancasse una componente che i veri giocatori di scacchi umani avrebbero, e quindi giocasse a scacchi in modo difettoso; sarebbe come aspettarsi che un braccio robotico privo di sangue fallisca nello stesso modo in cui fallirebbe un braccio umano privo di sangue.

Deep Blue giocava semplicemente a scacchi al livello di Kasparov attraverso un diverso tipo di cognizione.

Deep Blue mancava anche di — possiamo esserne davvero sicuri, perché si tratta di un vecchio programma che esegue un codice che era compreso in tutti i suoi dettagli— una minima passione per gli scacchi.

Non provava alcun piacere nel giocare a scacchi né desiderava dimostrare di essere il migliore.

Un giocatore umano emergente, improvvisamente privato di queste spinte, sarebbe fortemente penalizzato; un ingranaggio fondamentale sarebbe stato strappato dalla sua versione di cognizione.

Deep Blue non era penalizzato perché usava un motore cognitivo diverso che non aveva bisogno di quell'ingranaggio. L'errore di Kasparov è stato quello di non riuscire a immaginare un modo completamente diverso di giocare a scacchi, usando stati cognitivi interni completamente diversi dai suoi. Il suo errore è stato il meccanoscetticismo, che alla fine era solo antropomorfismo con un passo in più.

Per fortuna, l'umanità non si estingue quando i grandi maestri di scacchi sottovalutano il potere dell'IA, quindi siamo ancora tutti qui a riflettere sull'errore di Kasparov.

Antropomorfismo e copertine di riviste pulp

L'errore opposto, l'antropomorfismo, può essere molto più sottile.

Il cervello umano si è evoluto per prevedere gli altri esseri umani (che sono gli unici seri rivali cognitivi presenti nel nostro ambiente ancestrale) mettendoci nei loro panni.

Questo tipo di operazione funziona meglio se i panni in cui cercate di mettervi sono abbastanza simili ai vostri.

Nel corso della storia, molte persone hanno pensato: "Probabilmente quest'altra persona farebbe la stessa cosa che farei io!", ma poi l'altra persona non si è rivelata così simile. Alcuni sono morti a causa di ciò, altri hanno avuto il cuore spezzato dall'ottimismo — anche se, ovviamente, lo stesso si può dire di molti altri tipi di errori umani.

Ma cos'altro può fare una mente umana di fronte al problema di prevedere un altro cervello? Non possiamo scrivere un nuovo codice da far girare nel nostro cervello per prevedere quell'altra mente simulando in modo esaustivo le sue scariche neurali.

Dobbiamo dire al nostro cervello di essere quel cervello, di simulare dentro di noi lo stato mentale dell'altra persona e vedere cosa ne consegue.

Ecco perché le copertine delle riviste pulp raffigurano dei mostri alieni dagli occhi sporgenti che rapiscono delle belle donne.

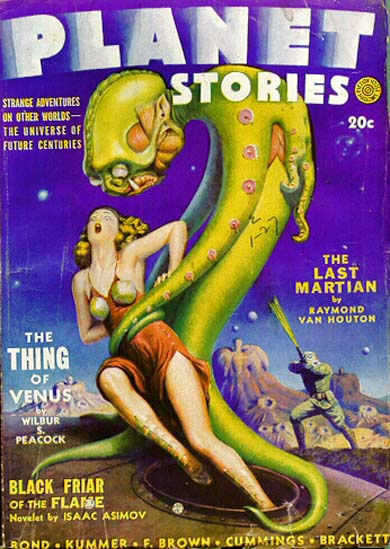

Copertina di un numero di Planet Stories, una rivista di fantascienza che è uscita dal 1939 al 1955 e che ha avuto collaboratori del calibro di Ray Bradbury e Isaac Asimov.

Copertina di un numero di Planet Stories, una rivista di fantascienza che è uscita dal 1939 al 1955 e che ha avuto collaboratori del calibro di Ray Bradbury e Isaac Asimov.

Perché mai il mostro alieno dagli occhi sporgenti non dovrebbe essere attratto da una bella donna? Le belle donne non sono forse intrinsecamente attraenti?

(Per qualche ragione, le copertine di quelle riviste non mostravano mai maschi umani che portavano via insetti giganti poco vestiti.†)

Gli scrittori e gli illustratori, supponiamo, non avevano elaborato una storia ben ragionata su come gli alieni insettoidi potessero avere una storia evolutiva che li portasse a vedere le donne umane come oggetti sessuali. Era solo che quando si mettevano nei panni degli alieni, immaginavano di vedere le donne come attraenti, quindi non sembrava loro strano immaginare che gli alieni provassero la stessa cosa. Non sembrava assurdo che un alieno volesse accoppiarsi con una bella donna umana, così come sarebbe stato assurdo se l'alieno avesse voluto accoppiarsi con un pino o un pacchetto di pasta.

Se volete provare a prevedere la mente di un alieno usando le vostre intuizioni umane, dovete stare molto attenti a lasciare da parte i vostri pregiudizi umani quando adottate la prospettiva dell'alieno. Questo è doppiamente valido quando l'alieno non è una creatura evoluta, ma una mente artificiale creata con metodi completamente diversi. Si veda anche l'ulteriore discussione sulle differenze tra discesa del gradiente e selezione naturale e sul vedere le cose dal punto di vista dell'IA.

Guardare oltre l'umano

L'antropomorfismo e il meccanomorfismo sono in fondo due lati della stessa fallacia, che dice: "Se una mente funziona, allora deve funzionare come quella umana".

- L'antropomorfismo dice: "Questa mente funziona. Quindi deve essere simile a quella umana!".

- Mentre il meccanomorfismo dice: "Questa mente non è simile a quella umana. Quindi non può funzionare!".

Ma una delle grandi lezioni del progresso dell'IA nel corso di molti decenni è che il modo umano non è l'unico modo con cui una mente può funzionare.

Una mente può essere artificiale senza essere non intelligente — può essere flessibile, adattabile, intraprendente e creativa, a prescindere da quello che dicono gli stereotipi hollywoodiani sui robot.

E una mente può essere intelligente senza essere umana — senza provare disgusto o risentimento, senza avere un senso umano della bellezza e senza trovare le mosse negli scacchi nel modo in cui lo farebbe un essere umano.

Una mente come quella di Deep Blue può comportarsi come se "volesse vincere" senza avere emozioni. Un'IA può comportarsi come se volesse qualcosa — superando competentemente gli ostacoli, perseguendo tenacemente un risultato — senza sentire una spinta o un desiderio interiore allo stesso modo di un essere umano e senza volere gli stessi tipi di risultati che vogliono gli esseri umani.

Per saperne di più su ciò che le IA finiranno per volere, proseguite con il Capitolo 4.

* Oggi abbiamo anche programmi di scacchi che funzionano un po' più come immaginava Kasparov, mescolando alberi di ricerca (che possono essere considerati più "logici") con reti neurali (più "intuitive").

† Sì, ci rendiamo conto che ormai su Internet si possono trovare immagini di uomini muscolosi che trasportano insetti giganti. Se queste immagini non esistono già, appariranno circa dodici secondi e mezzo dopo la pubblicazione di questa pagina web. Ma non pensiamo che all'epoca fossero presenti sulle copertine delle riviste.

Notes

[1] sceneggiatori di Hollywood: Come si vede, ad esempio, nell'episodio di Star Trek "Charlie X", trasmesso per la prima volta il 15 settembre 1966, in cui il logico Mr. Spock perde contro il capitano Kirk in una partita a "scacchi 3D", criticando la mossa ispirata di Kirk come "illogica".

[2] Deep Blue: L'architettura di Deep Blue è descritta in modo abbastanza chiaro nell'articolo "Deep Blue" di Murray Campbell, Joseph Hoane Jr. e Feng-hsiung Hsu.