Eficacia, conciencia y bienestar de la IA

En las preguntas frecuentes del capítulo 1, distinguimos varios conceptos de «conciencia». La versión de la conciencia de la que hablaremos aquí se denomina a veces «experiencia subjetiva», «sintiencia» o «conciencia fenomenológica». Se trata de la idea de que hay algo que se siente al ser esa entidad; metafóricamente hablando, las luces están encendidas.

También dijimos en las preguntas frecuentes que creemos que la inteligencia artificial probablemente no requiere conciencia artificial. Hablaremos de ese tema aquí y luego pasaremos a la cuestión de la ética y los derechos de la IA.

La experiencia consciente es independiente de los referentes de esas experiencias

Algunas personas se muestran escépticas ante la idea de que una IA pueda ser realmente inteligente sin ser consciente como lo son los seres humanos. Sospechamos que esto es un error, como imaginar que los brazos robóticos deben ser blandos y estar llenos de sangre solo porque los brazos humanos son blandos y están llenos de sangre.

¿Cómo podría una IA ser eficaz sin ser consciente como lo son los humanos? ¿No es la experiencia subjetiva de la autoconciencia un componente crucial de nuestra inteligencia?

Es un componente crucial de la inteligencia humana, sí. Pero dudamos que sea la única forma de ser inteligente.

Recordemos que Deep Blue no necesitaba ser consciente para superar a los mejores grandes maestros humanos en el ajedrez. La inteligencia distribuida del mercado de valores da lugar a predicciones sobrehumanas respecto a los movimientos a corto plazo de los precios de las empresas, sin que el mercado en sí tenga conciencia subjetiva. Es intuitivo que, al menos en estos ámbitos, se puede tener un modelo del mundo, una planificación y una toma de decisiones competentes sin tener conciencia.

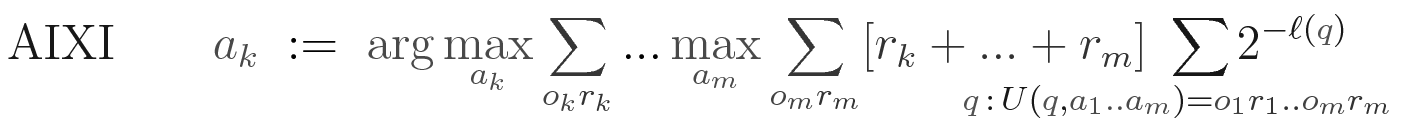

Este punto puede reforzarse observando los modelos formales de razonamiento. AIXI, por ejemplo, es una ecuación que define un razonador ampliamente superhumano.* Todo el algoritmo de AIXI puede expresarse en una sola línea, sin pasos en el algoritmo en los que AIXI haga nada consciente o autoconsciente o en absoluto misterioso. Sin embargo, a pesar de ello, AIXI es teóricamente capaz de resolver una increíble variedad de complicados problemas de dirección y predicción. O, al menos, sería capaz de hacerlo, si fuera posible crearlo.† Esta es la ecuación de AIXI:

Fuente de la imagen:https://www.hutter1.net/ai/uaibook.htm

Fuente de la imagen:https://www.hutter1.net/ai/uaibook.htm

AIXI es un constructo teórico, no un algoritmo práctico que podamos ejecutar para resolver problemas de manera eficiente en el mundo real. Pero como AIXI es simple y fácil de analizar, puede ayudarnos a reflexionar sobre el concepto mismo de dirección y planificación y ver que, al menos, no hay ninguna forma obvia en la que estas actividades requieran conciencia. Si la conciencia es necesaria para la dirección y la planificación sobrehumanas en el mundo real, entonces debe deberse a algún aspecto más sutil de la cognición que no se capta en el formalismo de AIXI.

O, para abordar el tema desde otro ángulo: pensemos en estornudar.

Hay algo en particular que se siente al estornudar, aparte del acto físico de contraer los músculos y expulsar explosivamente el aire de los pulmones a través de la boca y la nariz. Las acciones y las sensaciones son eventos físicos separados. Biológicamente, es posible construir un aparato similar a un cuerpo, pero sin cerebro, y conectarlo a las señales nerviosas que provocan las contracciones musculares de un estornudo. Ese cuerpo sin cerebro realizaría todos los movimientos, pero no tendría ninguna de las sensaciones asociadas: los mecanismos que llevan a cabo el estornudo son distintos de los que crean y experimentan las sensaciones.

Eso no quiere decir que las sensaciones de un estornudo no hagan nada. La experiencia subjetiva es real, y la experiencia subjetiva de un estornudo puede llevar a una persona a decir algo como «Vaya, estornudar es un poco raro», y eso no ocurriría en el caso del cuerpo sin cerebro.

La cuestión es que las sensaciones que tienen los seres humanos cuando estornudan se construyen a partir de elementos adicionales, más allá de los que contraen los músculos y expulsan el aire.

Al igual que con los estornudos, lo mismo ocurre con los pensamientos. La maquinaria mental que implementa un pensamiento es diferente de la maquinaria mental que implementa la sensación de ese pensamiento. Podemos afirmar con gran seguridad que esto es cierto para una enorme variedad de pensamientos, ya que las calculadoras de bolsillo y las IA de ajedrez realizan con éxito las tareas de aritmética y ajedrez sin tener la experiencia consciente de un matemático humano o un gran maestro de ajedrez.

Los pensamientos y las sensaciones de los pensamientos se implementan en el cerebro, lo que hace que sea más fácil confundirlos; la distinción es más evidente en el caso de los estornudos. Pero creemos que, en principio, es igualmente posible crear una variante del cerebro que realice la misma labor práctica de resolución de problemas que el cerebro humano, pero que no sienta nada de ese pensamiento.

Un cerebro así podría necesitar partes adicionales que realicen el trabajo que sentir los pensamientos hace en nosotros. Quizás la experiencia subjetiva de los pensamientos sea parte de cómo los seres humanos razonamos de forma reflexiva, y quizás el razonamiento reflexivo sea una parte importante de la inteligencia humana.

Pero dudamos que la experiencia subjetiva sea la única forma de reflexionar (o cualquier otra cosa), del mismo modo que la curiosidad al estilo humano no es la única forma de investigar fenómenos sorprendentes. (Véase también el debate sobre la curiosidad en el recurso en línea del capítulo 4).

Las estructuras análogas permiten múltiples soluciones para un mismo problema

Nuestra mejor suposición es que la mayoría de las IA más inteligentes que los humanos no serían conscientes por defecto. Esto se debe a que nuestra mejor suposición es que no todos los motores de pensamiento posibles deben utilizar sentimientos conscientes para guiar sus pensamientos. La conciencia puede desempeñar una función importante en los seres humanos, sin que sea la única forma en que cualquier mente posible pueda realizar un trabajo cognitivo análogo.

En biología evolutiva, los científicos utilizan el término «estructuras análogas» para referirse a rasgos que cumplen la misma función en diferentes animales, pero que tienen orígenes anatómicos distintos.

(Esto se diferencia de la evolución convergente, en la que múltiples especies desarrollan la misma adaptación, como el urushiol y la cafeína, que fueron «descubiertos» varias veces por la evolución).

Las luciérnagas producen luz utilizando enzimas para oxidar la sustancia química luciferina en unas «células linterna» especiales. Por el contrario, los rapes abisales tienen una relación simbiótica con fotobacterias que albergan en un pequeño órgano, bacterias cuya producción de luz utiliza una vía química distinta a la de las luciérnagas.

Los mamíferos desarrollaron dientes; las aves resolvieron el mismo problema con una molleja y tragando piedras. Los murciélagos producen ultrasonidos con la laringe y reciben los ecos con los oídos; las ballenas y los delfines utilizan un órgano nasal para generar sonidos y reciben los ecos con sistemas sensibles en sus mandíbulas. Algunas especies acuáticas nadan empujando el agua con sus extremidades y otras expulsando agua de una vejiga. Las alas de los murciélagos evolucionaron a partir de la membrana de las manos, y las de las aves, a partir de los brazos.

En otras palabras, hay muchas formas de diseñar estructuras que resuelvan los mismos problemas. Los ingenieros humanos, sin las limitaciones de la evolución, han resuelto cada uno de estos problemas de formas aún más extrañas: con velas encendidas, bombillas incandescentes y LED; con cuchillos, licuadoras y procesadores de alimentos; con veleros, hélices y equipos de buceo; con sonares y radares.

Un brazo humano al que se le extrae la sangre dejaría de funcionar, pero eso no significa que los brazos robóticos deban usar sangre; pueden funcionar de alguna otra manera, sin sangre.

Del mismo modo, las piezas de la maquinaria cognitiva que implementan el comportamiento de la curiosidad en los seres humanos son diferentes de las piezas de la maquinaria cognitiva que implementan nuestro sentimiento de curiosidad. La satisfacción que siente un ser humano cuando desentraña el misterio de la zarigüeya en el ático es distinta de su comportamiento externo de decidir investigar el cajón que siempre está abierto. Esas dos cosas pueden venir juntas en los seres humanos, pero eso no significa que deban venir juntas en todas las mentes.

Y dado que no entendemos con precisión qué llevó a la evolución de la experiencia subjetiva en los seres humanos, y podemos ver todo tipo de comportamientos agénticos y de resolución de problemas en el mundo en procesos que carecen de ella —

(mohos mucilaginosos resolviendo un laberinto; Deep Blue ganando en el ajedrez; mercados bursátiles prediciendo el éxito de las empresas; etc.)

— no vemos ninguna razón en particular para esperar firmemente que una superinteligencia comparta esta extraña propiedad humana por defecto.

«No es necesario» no significa «definitivamente no sucederá»

Si estamos en lo cierto al afirmar que la conciencia al estilo humano es complicada y contingente, eso no garantiza, por supuesto, que las IA no serán conscientes. Las empresas de IA están construyendo actualmente IA entrenándolas para predecir a los humanos, y eso probablemente hará que los componentes internos de la IA imiten al menos algunos aspectos de la conciencia humana con fines de modelado.

Quizás la IA produzca ocasionalmente modelos de humanos tan detallados que esos modelos en la cabeza de la IA sean ellos mismos brevemente conscientes. O quizás los engranajes que la IA utiliza para modelar los sentimientos humanos resulten útiles fuera de los modelos humanos, y la IA termine teniendo sentimientos propios. No lo sabemos.

Dada la aparente contingencia y complejidad de la conciencia humana, y el hecho de que las IA se desarrollan utilizando procesos radicalmente diferentes a los que dieron origen a los seres humanos, nuestra expectativa por defecto es que nada parecido a la maquinaria involucrada en la conciencia humana aparecerá en los tipos de IA que la humanidad probablemente construirá.

Si la humanidad construye una IA superinteligente en un futuro próximo, prevemos que el desenlace sea la extinción humana. Con menos certeza, nuestra mejor suposición es que dicha IA no sería consciente. Y, sea consciente o no, esperamos que convierta el mundo en un lugar sin vida y desolado, por las razones expuestas en el debate ampliado «Perder el futuro».

Pero al menos parece posible que, si los humanos creamos una superinteligencia artificial, esta tenga experiencias conscientes propias. Parece posible —aunque bastante improbable, porque hay muchas más posibilidades sombrías— que apresurarse a desarrollar IA podría dar lugar a un futuro lleno de seres de IA curiosos y conscientes que nos mataran a todos y luego construyeran su propia civilización y arte magníficos. Parece posible que las IA pudieran cuidarse unas a otras y encontrar satisfacción en sus creaciones; y si fuera así, esto sería menos trágico que un futuro que terminara siendo un enorme páramo. Es difícil expresar con palabras el alcance de una atrocidad como el asesinato en masa de todos los seres humanos, pero existe al menos una pequeña posibilidad de que la rápida toma de poder por parte de la IA pueda dar lugar a un futuro que no sea totalmente sombrío y sin vida.

Sospechamos que algunos investigadores de IA están imaginando ese tipo de futuro cuando parecen no preocuparse por matarnos a todos (de formas que mencionamos en otra parte). Si se asume que la IA desarrollará necesariamente conciencia, sentimientos y preocupación por los de su propia especie (si no por los humanos), entonces es más fácil concluir que sus extrañas actividades no son tan preocupantes. Es más fácil imaginar que aquellos que se oponen a la carrera hacia la superinteligencia son como padres tradicionalistas que se quejan de que sus hijos escuchan música demasiado estridente.

Pero esta visión es demasiado optimista.

La biología rara vez encuentra soluciones óptimas a los problemas. Las alas y los pulmones de un pájaro son ineficaces en comparación con los motores de un avión moderno. Cuando los humanos construimos aviones sin las limitaciones biológicas, descartamos la mayoría de las características detalladas de la biología de las aves.

La conciencia no parece un proceso sencillo; no es fácil ver cómo podríamos construir algo así, por lo que probablemente haya mucho más detrás. (Compárese con el caso del vitalismo: los científicos de antaño creían que los cuerpos estaban animados por un simple espíritu vital, en parte porque, aunque estar animado parecía lo más fácil del mundo, no veían ninguna forma de imbuir a la materia inanimada con esa propiedad. Pero resultó que la animación no era simple, ni era magia, sino que la biología era realmente muy compleja y los científicos de la época aún no la entendían).

Incluso si una IA comienza con algunos de los engranajes de la conciencia, es probable que la conciencia no sea la mejor manera de hacer el trabajo que hace en nosotros. Nos preocupa que la maquinaria detrás de la conciencia en los seres humanos esté llena de detalles. Incluso si una IA tiene muchos de los engranajes de la conciencia para empezar, es probable que encuentre otras veinte formas de hacer el trabajo de manera más eficiente y que descarte esas chispas de conciencia en lugar de encenderlas. Ser consciente y valorar la conciencia son propiedades diferentes.

El futuro trágico y probable no es aquel en el que nuestros sucesores simplemente tengan gustos o valores distintos a los nuestros. El problema no es que nuestros hijos mecánicos escuchen música demasiado estridente para nuestro gusto. No, prevemos IA que carecerán de cualquier forma de sintiencia; que serán sistemas poderosos pero vacíos que transformarán todo lo que toquen en un páramo sin vida, consumiéndose finalmente a sí mismos para sumar un último punto a su recuento. Dejarían atrás un mundo muerto, sin nadie para apreciarlo.

Ese es un destino que vale la pena evitar.

Véase también nuestra discusión más extensa sobre preocuparse por todos los seres sintientes y el debate ampliado sobre perder el futuro.

Las IA sintientes merecerían derechos

Dada la dificultad de determinar con certeza si las IA modernas son sintientes, ¿deberíamos preocuparnos por el bienestar de ChatGPT?

¿Tiene sentido hablar de «bienestar» en este contexto?

¿Puede ChatGPT sufrir? ¿Deberíamos tratarlo como si tuviera derechos morales?

Si las IA actuales no son conscientes en el sentido de tener una experiencia subjetiva, ¿qué pasará con las IA futuras? ¿Cómo podríamos saberlo, dado que las estamos entrenando para que respondan como si lo fueran, enseñándoles a imitar la comunicación humana?

Nuestra postura es la siguiente: si las IA son conscientes, merecen derechos y un buen trato.‡

Valoramos enormemente la humanidad, pero no somos carbonocéntricos que piensen que solo las formas de vida basadas en el carbono pueden tener importancia moral. Creemos que las cosas que hacen valiosos a los seres humanos pueden, en principio, replicarse en otros medios, incluido el silicio. Creemos que Blake Lemoine se equivocó cuando dijo en 2022 que la IA LaMDA de Google era un ser sintiente en toda regla; pero no creemos que Lemoine se equivocara al afirmar que, si algunas IA son sintientes, tenemos el deber de tratarlas bien.§

Si las IA se vuelven sintientes, probablemente seguirán teniendo objetivos incompatibles con los nuestros. Si luego se vuelven superinteligentes, en un mundo en el que aún estamos a décadas o siglos de controlar la alineación de la IA, probablemente preferirán matarnos a todos.

La humanidad tendría que evitar que esas IA se volvieran superinteligentes, o el resultado sería la muerte masiva de la humanidad y la destrucción del futuro. Pero si las IA en cuestión son sintientes, además de peligrosas, eso solo aumentaría la tragedia de la situación.

Si las empresas de IA encuentran alguna forma de hacer que sea menos probable que sus IA sean conscientes, creemos que sería más sensato y prudente optar por esa opción y hacer que sea lo más probable posible que las IA no sean conscientes (al menos mientras nos encontremos en un entorno social y técnico similar al actual). No cambia mucho el nivel general de peligro al que se enfrenta actualmente nuestra especie, pero es lo correcto, porque reduciría el riesgo de que la humanidad esclavice o maltrate a nuevos seres moralmente valiosos.

Y si algún día la humanidad encuentra la manera de construir una IA más inteligente que los humanos sin acabar con nosotros mismos, una IA que se preocupe por el bien y que haga el bien con sus capacidades, entonces, en ese futuro, los autores esperamos fervientemente que la humanidad construya máquinas sintientes que sean nuestras amigas en un universo por lo demás vasto y frío, y esperamos fervientemente que la humanidad trate a esas amigas mejor de lo que nuestro historial podría llevar a predecir.

Pero primero, y sobre todo, no construyamos una superinteligencia que nos masacre a todos, sea consciente o no.

* Bajo ciertas suposiciones que no se pueden realizar; en términos generales, requiere una cantidad infinita de poder de cómputo y un lugar perfectamente seguro donde almacenarlo.

† Dado que AIXI es imposible de crear, se podría sospechar que se trata de una herramienta puramente teórica con poca relevancia para la revolución práctica de la IA moderna. Pero, de hecho, AIXI fue estudiado y utilizado como modelo de inteligencia por muchas de las personas que hoy están a la vanguardia de la IA, incluidos Shane Legg (cofundador de Google DeepMind), Ilya Sutskever (cofundador de OpenAI y coinventor de AlexNet) y David Silver (líder de investigación de AlphaGo y AlphaZero).

‡ E incluso antes de llegar a ese punto, en el momento en que pueden hacer planes y perseguir sus preferencias, debemos cumplir nuestras promesas y compromisos con ellos, como se comenta en una nota al pie en otra parte.

§ Y para dejar claro lo que (esperemos) es obvio: no deberíamos andar creando una nueva especie esclava sintiente, sea mecánica o no. A estas alturas, deberíamos ser más sensatos.

Notes

[1] un aspecto más sutil: AIXI contiene técnicamente experiencias conscientes, dentro de su modelo del mundo, si la conciencia es independiente del sustrato. Las hipótesis que AIXI utiliza para su razonamiento son tan enormes que pueden considerarse universos por derecho propio, los cuales incluyen observadores que viven dentro de AIXI.