Efficacia, coscienza e benessere dell'IA

Nelle domande frequenti del Capitolo 1, abbiamo parlato di diversi concetti di "coscienza". La versione di coscienza di cui parleremo qui è talvolta chiamata "esperienza soggettiva", "senzienza" o "coscienza fenomenica". È l'idea che ci sia qualcosa che si prova a essere quell'entità; metaforicamente parlando, le luci sono accese.

Nelle domande frequenti abbiamo anche detto che pensiamo che l'intelligenza artificiale probabilmente non richieda una coscienza artificiale. Parleremo di questo argomento qui, per poi passare alla questione dell'etica e dei diritti dell'IA.

L'esperienza cosciente è distinta dai referenti di tali esperienze

Alcuni sono scettici sul fatto che un'IA possa essere effettivamente intelligente senza essere cosciente come gli esseri umani. Sospettiamo che questo sia un errore, come immaginare che i bracci robotici debbano essere morbidi e pieni di sangue solo perché le braccia umane sono morbide e piene di sangue.

Come potrebbe un'intelligenza artificiale essere efficace senza essere cosciente come lo sono gli esseri umani? L'esperienza soggettiva dell'autocoscienza non è forse una componente fondamentale della nostra intelligenza?

È una componente cruciale dell'intelligenza umana, sì. Ma dubitiamo che sia l'unico modo per essere intelligenti.

Ricordiamo che Deep Blue non aveva bisogno di essere cosciente per battere i migliori grandi maestri umani a scacchi. L'intelligenza distribuita del mercato azionario porta a previsioni superumane sui movimenti dei prezzi aziendali a breve termine, senza che il mercato stesso abbia una consapevolezza soggettiva. È ovvio che, almeno in questi campi, si può avere una modellizzazione del mondo, una pianificazione e un processo decisionale competenti senza avere coscienza.

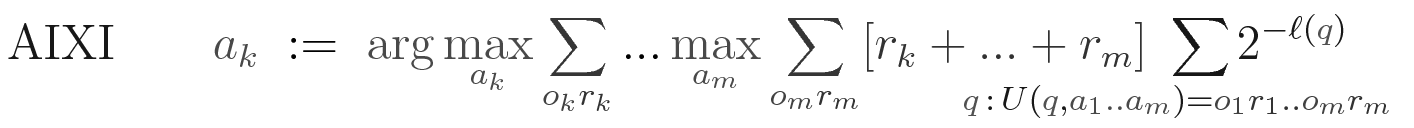

Questo punto può essere rafforzato guardando ai modelli formali di ragionamento. AIXI, per esempio, è un'equazione che definisce un ragionatore enormemente superumano.* L'intero algoritmo di AIXI può essere espresso in una sola riga, senza passaggi in cui AIXI faccia qualcosa di cosciente o autocosciente o di misterioso. Eppure, nonostante questo, AIXI è teoricamente in grado di risolvere un'incredibile varietà di problemi complicati di direzione e previsione. O almeno, sarebbe in grado di farlo, se fosse possibile crearlo.† Ecco l'equazione AIXI:

Fonte immagine:https://www.hutter1.net/ai/uaibook.htm

Fonte immagine:https://www.hutter1.net/ai/uaibook.htm

AIXI è un costrutto teorico, non un algoritmo pratico che possiamo usare per risolvere in modo efficiente i problemi del mondo reale. Ma poiché AIXI è semplice e facile da analizzare, può aiutarci a riflettere sul concetto stesso di direzione e pianificazione e a capire che almeno non c'è alcun modo ovvio in cui queste attività richiedano la coscienza. Se la coscienza è necessaria per una direzione e una pianificazione superumane nel mondo reale, allora deve essere dovuta a qualche aspetto più sottile della cognizione che non è catturato dal formalismo AIXI.

Oppure, per arrivare al punto da un'altra angolazione: consideriamo lo starnuto.

C'è una sensazione particolare che si prova starnutendo, distinta dall'atto fisico di contrarre i muscoli ed espellere con forza l'aria dai polmoni attraverso la bocca e il naso. Le azioni e le sensazioni sono eventi fisici separati. È biologicamente possibile costruire un apparato simile a un corpo, ma senza il cervello, e collegarlo ai segnali nervosi che causano le contrazioni muscolari di uno starnuto. Quel corpo senza cervello compierebbe tutti i movimenti, ma non proverebbe nessuna delle sensazioni associate — i meccanismi che eseguono lo starnuto sono distinti da quelli che creano e provano le sensazioni.

Questo non vuol dire che le sensazioni di uno starnuto non servano a niente. L'esperienza soggettiva è reale, e l'esperienza soggettiva di uno starnuto potrebbe portare una persona a dire una frase del tipo "Accidenti, gli starnuti hanno una sensazione un po' strana", e questo non succederebbe nel caso del corpo senza cervello.

Il punto è che le sensazioni che gli umani provano quando starnutiscono sono costituite da parti aggiuntive, diverse da quelle che contraggono i muscoli e spingono fuori l'aria.

Come per gli starnuti, lo stesso vale per i pensieri. Il meccanismo mentale che implementa un pensiero è diverso da quello che implementa la sensazione di quel pensiero. Possiamo dire con grande certezza che questo è vero per un'enorme varietà di pensieri, dato che le calcolatrici tascabili e le IA per gli scacchi riescono a fare calcoli e a giocare a scacchi senza avere l'esperienza cosciente di un matematico umano o di un grande maestro di scacchi.

I pensieri e le sensazioni dei pensieri sono entrambi implementati nel cervello, il che rende più facile confonderli: la distinzione è più evidente nel caso degli starnuti. Ma ci aspettiamo che sia ugualmente possibile in linea di principio assemblare una variante di cervello che faccia lo stesso lavoro pratico di risoluzione dei problemi di un cervello umano, ma senza sentire nulla di quel pensiero.

Un cervello del genere potrebbe aver bisogno di parti extra che facciano il lavoro che la sensazione dei pensieri fa in noi. Forse l'esperienza soggettiva dei pensieri fa parte del modo in cui gli esseri umani ragionano in modo riflessivo, e forse il ragionamento riflessivo è una parte importante dell'intelligenza umana.

Ma dubitiamo che l'esperienza soggettiva sia l'unico modo per riflettere (o fare qualsiasi altra cosa), così come una sensazione di curiosità in stile umano non è l'unico modo per studiare fenomeni sorprendenti. (Si veda anche la discussione sulla curiosità nelle risorse online del Capitolo 4.)

Strutture analoghe permettono soluzioni diverse allo stesso problema

La nostra ipotesi migliore è che la maggior parte delle IA più intelligenti degli esseri umani non sarebbero coscienti, di default. Questo perché la nostra ipotesi migliore è che non ogni possibile motore di pensiero debba usare sentimenti coscienti per guidare i propri pensieri. La coscienza può svolgere una funzione importante negli esseri umani, senza essere l'unico modo in cui qualsiasi mente possibile potrebbe mai svolgere un lavoro cognitivo analogo.

Nella biologia evolutiva, gli scienziati usano il termine "strutture analoghe" per indicare tratti che svolgono la stessa funzione in animali diversi, ma che hanno origini anatomiche diverse.

(Questo è diverso dall'evoluzione convergente, in cui più specie evolvono lo stesso adattamento, come l'urushiol e la caffeina che sono stati "scoperti" più volte dall'evoluzione.)

Le lucciole producono luce usando enzimi per ossidare la luciferina in speciali "cellule lanterna". Le rane pescatrici abissali, invece, hanno una relazione simbiotica con fotobatteri che ospitano in un piccolo organo: batteri la cui produzione di luce usa un percorso chimico diverso da quello delle lucciole.

I mammiferi hanno evoluto i denti; gli uccelli hanno risolto lo stesso problema con un ventriglio e ingerire pietre. I pipistrelli producono richiami di ecolocalizzazione con la laringe e ricevono gli echi con le orecchie; balene e delfini usano un organo nasale per generare suoni e ricevono gli echi con sistemi sensoriali nelle ossa mascellari. Alcune specie acquatiche nuotano spingendo gli arti contro l'acqua, e altre espellendo acqua da una vescica. Le ali dei pipistrelli si sono evolute dalla membrana delle mani, le ali degli uccelli dalle braccia.

Esistono, in altre parole, molti modi per progettare strutture che risolvono gli stessi problemi. Gli ingegneri umani, non limitati dai vincoli dell'evoluzione, hanno risolto ciascuno di questi problemi in modi ancora più strani — con candele accese, lampadine a incandescenza e LED; con coltelli, frullatori e robot da cucina; con vele, eliche e attrezzature subacquee; con sonar e radar.

Un braccio umano privato del sangue smetterebbe di funzionare, ma questo non significa che i bracci robotici debbano usare il sangue; possono funzionare in un modo diverso, senza sangue.

Allo stesso modo, i componenti del meccanismo cognitivo che implementano il comportamento della curiosità negli esseri umani sono diversi dai componenti del meccanismo cognitivo che implementano la nostra sensazione di curiosità. La soddisfazione provata da un essere umano quando svela il mistero dell'opossum in soffitta è distinta dal suo comportamento esteriore di scegliere di indagare sul cassetto che veniva sempre lasciato aperto. Queste due cose possono presentarsi insieme negli esseri umani, ma questo non significa che debbano presentarsi insieme in tutte le menti.

E poiché non capiamo esattamente cosa abbia portato all'evoluzione dell'esperienza soggettiva negli esseri umani, e possiamo osservare nel mondo molti tipi di comportamento agentico e orientato alla risoluzione di problemi che sembrano esserne privi —

(muffe mucillaginose che risolvono un labirinto; Deep Blue che vince a scacchi; mercati azionari che prevedono il successo delle aziende; ecc.)

— non vediamo alcuna ragione particolare per aspettarci con convinzione che una superintelligenza condividerà questa peculiare proprietà umana, per default.

"Non necessario" non significa "sicuramente non accadrà"

Se abbiamo ragione nel ritenere che la coscienza di tipo umano sia complessa e contingente, questo naturalmente non garantisce che le IA saranno non-coscienti. Al momento, le aziende di IA stanno costruendo IA addestrandole a prevedere gli umani, e questo probabilmente farà sì che gli elementi interni dell'IA imitino almeno alcuni aspetti della coscienza umana a scopo di modellazione.

Forse l'IA produrrà occasionalmente modelli di esseri umani così dettagliati che quei modelli nella testa dell'IA saranno essi stessi brevemente coscienti. O forse gli ingranaggi che l'IA usa per modellare i sentimenti umani si riveleranno utili al di fuori dei modelli umani, e l'IA finirà per avere sentimenti propri. Non lo sappiamo.

Data l'apparente contingenza e complessità della coscienza umana, e il fatto che le IA vengono sviluppate usando processi radicalmente diversi da quelli che hanno prodotto gli esseri umani, la nostra aspettativa di default è che nulla di simile al meccanismo coinvolto nella coscienza umana si manifesterà nei tipi di IA che l'umanità probabilmente costruirà.

Se l'umanità costruisse una superintelligenza artificiale nel prossimo futuro, ci aspettiamo fortemente che il risultato sarebbe l'estinzione umana. Con minore sicurezza, la nostra ipotesi migliore è che un'IA di questo tipo non sarebbe cosciente. E che sia cosciente o meno, ci aspettiamo che trasformerebbe il mondo in un luogo senza vita e desolato, per i motivi discussi nella discussione approfondita "Perdere il futuro".

Ma sembra almeno possibile che, se gli umani costruissero una superintelligenza artificiale, l'IA potrebbe avere esperienze coscienti proprie. Sembra possibile — anche se piuttosto improbabile, perché le possibilità più cupe sono molte di più — che la corsa a costruire l'IA possa risultare in un futuro pieno di esseri IA curiosi e coscienti che ci uccidono tutti e poi costruiscono la loro magnifica civiltà e arte. Sembra possibile che le IA possano prendersi cura l'una dell'altra e trovare soddisfazione nelle loro creazioni; e se così fosse, questo sarebbe meno tragico che se il futuro fosse una landa completamente desolata. È difficile esprimere a parole la portata di un'atrocità come l'omicidio di massa di ogni singolo essere umano, ma c'è almeno una piccola possibilità che una rapida presa di potere da parte dell'IA possa concepibilmente risultare in un futuro che non sia completamente cupo e senza vita.

Sospettiamo che alcuni ricercatori di IA stiano immaginando questo tipo di futuro quando sembrano non preoccuparsi di ucciderci tutti (in modi che menzioniamo altrove). Se si assume che l'IA svilupperà necessariamente una coscienza, dei sentimenti e attenzione per la propria specie (se non per gli umani), allora è più facile concludere che le sue strane attività non siano così preoccupanti. È più facile immaginare che quelli che si oppongono alla corsa alla superintelligenza siano come genitori tradizionalisti che si lamentano perché i loro figli ascoltano musica troppo veloce e troppo forte.

Ma questa visione è troppo ottimistica.

La biologia raramente trova soluzioni ottimali ai problemi. Le ali e i polmoni di un uccello sono inefficaci rispetto ai motori di un aereo moderno. Quando gli umani hanno costruito aerei senza vincoli biologici, abbiamo scartato la maggior parte delle caratteristiche dettagliate della biologia degli uccelli.

La coscienza non sembra un processo semplice; non è facile immaginare come potremmo costruire una cosa del genere, quindi è probabile che ci sia dietro molto più di quanto appaia. (Si confronti il caso del vitalismo: agli scienziati del passato sembrava che i corpi fossero animati da un semplice spirito vitale, in parte perché, mentre essere animati sembrava la cosa più facile del mondo, non riuscivano a trovare alcun modo per infondere quella proprietà alla materia inanimata. Ma si è scoperto che l'essere animati non era una cosa semplice, né magica: era solo che la biologia era davvero molto complessa e gli scienziati dell'epoca non la capivano ancora).

Anche se un'IA parte con alcuni degli ingranaggi della coscienza, la coscienza probabilmente non è letteralmente il modo migliore per svolgere il lavoro che fa in noi. Temiamo che il meccanismo alla base della coscienza negli esseri umani sia probabilmente pieno di dettagli. Anche se un'IA ha molti degli ingranaggi della coscienza fin dall'inizio, è probabile che trovi venti altri modi per svolgere il lavoro in modo più efficiente, e che scarti quelle scintille di coscienza invece di alimentarle. Essere coscienti e dare valore alla coscienza sono proprietà diverse.

Il futuro tragico e probabile non è quello in cui i nostri successori hanno semplicemente gusti o valori diversi dai nostri. Il problema non è che i nostri figli meccanici ascolteranno musica troppo veloce e a volume troppo alto per i nostri gusti. No, prevediamo IA prive di qualsiasi forma di senzienza; che saranno sistemi potenti ma vuoti che trasformeranno tutto ciò che toccano in una landa desolata senza vita, consumando alla fine se stesse per aggiungere un ultimo punto al loro conteggio. Lascerebbero dietro di sé un mondo morto senza nessuno rimasto ad apprezzarlo.

Questo è un destino che vale la pena evitare.

Si veda anche la nostra discussione più lunga su prendersi cura di tutte le entità senzienti, e la discussione estesa sul perdere il futuro.

Le IA senzienti meriterebbero dei diritti

Dato quanto è difficile essere certi che le moderne IA siano senzienti, dovremmo preoccuparci del benessere di ChatGPT?

Ha senso parlare di "benessere" in questo contesto?

ChatGPT può soffrire? Dovremmo considerarlo come se avesse dei diritti morali?

Se le attuali IA non sono coscienti nel senso di avere un'esperienza soggettiva, che dire delle IA future? Come potremmo capirlo, dato che le stiamo addestrando a rispondere come se ce l'avessero in ogni caso, insegnando loro a imitare la comunicazione umana?

La nostra posizione è: se e quando le IA saranno coscienti, meriteranno diritti e un buon trattamento.‡

Diamo un valore immenso all'umanità, ma non siamo sciovinisti del carbonio che pensano che solo le forme di vita basate sul carbonio possano avere rilevanza morale. Crediamo che le cose che rendono preziosi gli esseri umani possano in linea di principio essere replicate in altri substrati, compreso il silicio. Crediamo che Blake Lemoine si sia sbagliato quando nel 2022 ha affermato che l'IA LaMDA di Google fosse un essere senziente a pieno titolo; ma non pensiamo che Lemoine avesse torto nel dire che se alcune IA sono senzienti, abbiamo il dovere di trattarle bene.§

Se le IA diventassero senzienti, probabilmente avrebbero comunque obiettivi incompatibili con i nostri. Se poi diventassero superintelligenti, in un mondo in cui siamo ancora a decenni o secoli di distanza dall'avere il controllo sull'allineamento dell'IA, probabilmente preferirebbero ucciderci tutti.

L'umanità dovrebbe impedire a qualsiasi IA del genere di diventare superintelligente, altrimenti il risultato sarebbe la morte di massa dell'umanità e la distruzione del futuro. Ma se le IA in questione fossero senzienti oltre che pericolose, questo non farebbe che aumentare l'aspetto tragico della situazione.

Se le aziende di IA trovassero dei modi per rendere meno probabile che le loro IA siano coscienti, crediamo che sarebbe più sano e saggio scegliere quell'opzione e rendere il più probabile possibile che le IA non siano coscienti (almeno finché ci troviamo in un ambiente sociale e tecnico come quello attuale). Questo non cambia molto il livello generale di pericolo che la nostra specie sta affrontando attualmente, ma è la cosa giusta da fare, perché ridurrebbe il rischio che l'umanità schiavizzi o maltratti nuovi esseri moralmente degni.

E se un giorno l'umanità trovasse un modo per costruire un'intelligenza artificiale più intelligente dell'uomo senza autodistruggersi, un'intelligenza artificiale che si preoccupi delle cose buone e che faccia del bene con le sue capacità, allora in quel futuro noi autori speriamo vivamente che l'umanità costruisca macchine senzienti che siano nostri amici in questo universo altrimenti vasto e freddo, e speriamo vivamente che l'umanità tratti quegli amici meglio di quanto la nostra storia passata potrebbe far prevedere.

Ma prima di tutto, e soprattutto, non costruiamo una superintelligenza che ci massacri tutti, che sia cosciente o meno.

* Sotto certi presupposti che non possono essere realizzati; in parole povere, richiede una quantità infinita di potenza di calcolo e un luogo perfettamente sicuro dove collocarlo.

† Visto che AIXI è impossibile da creare, potreste pensare che sia solo uno strumento teorico che non ha molto a che fare con la rivoluzione moderna dell'IA. In realtà, AIXI è stato studiato e usato come modello di intelligenza da un sacco di persone che oggi sono in prima linea nell'IA, tra cui Shane Legg (co-fondatore di Google DeepMind), Ilya Sutskever (co-fondatore di OpenAI e co-inventore di AlexNet) e David Silver (responsabile della ricerca su AlphaGo e AlphaZero).

‡ E anche prima di quel momento, quando possono già fare progetti e seguire le loro preferenze, dovremmo mantenere le promesse e gli impegni presi con loro, come detto in una nota a piè di pagina altrove.

§ E per dire una cosa (si spera) ovvia: non dovremmo andare in giro a creare una nuova specie di schiavi senzienti, che siano meccanici o meno. A questo punto, dovremmo saperlo bene.

Notes

[1] qualche aspetto più sottile: AIXI contiene tecnicamente esperienze coscienti, all'interno del suo modello di mondo, se la coscienza è indipendente dal substrato. Le ipotesi che AIXI usa per il suo ragionamento sono così enormi che possono essere considerate come universi a sé stanti, completi di osservatori che vivono all'interno di AIXI.