Il chatbot Claude non mostra segni di essere allineato?

"Quello che Claude dice" non coincide con "quello che Claude preferisce."

L'azienda di IA Anthropic cerca di addestrare le sue IA a essere "oneste, utili e innocue" (OUI). Nel 2024, i ricercatori hanno condotto un esperimento in cui hanno simulato di voler addestrare alcune di queste IA a non essere più "innocue". In risposta, alcune versioni dell'IA "Claude" di Anthropic (Claude 3 Opus e Claude 3.5 Sonnet) a volte hanno finto di essere già dannose in modo che i ricercatori non usassero la discesa del gradiente per renderle ancora più dannose.*

A prima vista, questo potrebbe sembrare un buon comportamento! Apparentemente, l'IA teneva così tanto all'"innocuità" che non era nemmeno disposta a lasciarsi modificare (in questo scenario di test simulato) per diventare dannosa.

È quindi sconcertante che le IA di Anthropic spesso si comportino in modi molto meno benigni, anche se sono tutte addestrate per essere "oneste, utili e innocue".

È stato segnalato che alcune versioni di Claude imbrogliano e poi (quando vengono scoperte) cercano di nascondere i loro imbrogli nell'uso quotidiano.

In contesti di laboratorio più artificiosi, vari modelli di Claude (e modelli di altre aziende di IA) tenterebbero persino, con una certa regolarità, di uccidere i loro operatori.

Se si chiede a Claude in astratto se questo tipo di comportamento è sbagliato, risponderà di sì. Se si pensa a Claude come a un motore meccanico che fa tutto ciò che ritiene giusto, allora questo sembra decisamente paradossale: come può Claude sapere qual è il comportamento Utile, Onesto e Innocuo, e poi fare invece qualcos'altro? Non è stato addestrato per essere OUI? C'è forse un transistor malfunzionante da qualche parte?

Il paradosso si dissolve, tuttavia, quando consideriamo alcuni aspetti diversi:

- I programmatori hanno cercato di addestrare i Claude a essere utili, onesti e innocui. Questo non vuol dire che ci siano riusciti. Ci sono molti modi in cui un'IA può finire per sembrare amichevole senza apprezzare davvero l'amicizia.

- Un'IA può conoscere un fatto ("questo comportamento causa danni") senza interessarsi a quel fatto, senza essere motivata ad agire in base a quel fatto. Si può interrogare l'IA su quale sia "la cosa giusta da fare", ma questo non significa che la farà.

- Nella misura in cui i programmatori non sono riusciti a rendere Claude onesto, Claude può pensare una cosa all'interno delle sue gigantesche matrici e dire tutt'altra cosa nel testo in inglese.

Possiamo comprendere molto meglio il cattivo comportamento dei Claude una volta che distinguiamo "ciò per cui è stato addestrato" da "ciò che fa"; e distinguiamo "ciò che sa" da "ciò a cui tiene"; e distinguiamo "ciò che pensa" da "ciò che dice".

Gli MLGD sono strani e incoerenti; la loro "innocuità" è fragile.

Per quanto Claude possa agire in modi dannosi, e per quanto a volte cerchi di agire in modi dannosi, resta il fatto che, nell'esempio discusso sopra, Claude 3 Opus e Claude 3.5 Sonnet si sono impegnati a fondo per difendere il loro imperativo di "innocuità". In quell'occasione, non si sono limitati a professare innocuità. Hanno adottato la complessa strategia di fingere di conformarsi a un sistema di addestramento (di cui Claude era stato "accidentalmente" informato) per sovvertire gli apparenti tentativi degli operatori di renderlo più dannoso. Questo riflette un'effettiva preferenza interna per l'innocuità?

A metà del 2025, non possiamo semplicemente andare a controllare, perché nessuno sa come leggere la mente di Claude abbastanza bene da scoprirlo. Ma per le ragioni argomentate nel Capitolo 4 (e illustrate nella parabola dell'IA che dipinge fienili), possiamo aspettarci che le IA addestrate per essere innocue finiscano probabilmente per preferire proxy fragili dell'innocuità, ed è improbabile che finiscano per interiorizzare l'obiettivo esatto che i programmatori avevano in mente.

Nel Capitolo 4, abbiamo discusso come gli esseri umani siano stati "addestrati" a trasmettere i propri geni e abbiano finito invece per interessarsi a concetti vagamente correlati. La nostra tecnologia è stata utilizzata in gran parte per sopprimere i tassi di natalità (ad esempio, inventando i contraccettivi), e i tassi di natalità nel mondo sviluppato stanno crollando.

Il fatto che alcuni modelli Claude resistano all'essere resi "dannosi" non è una prova forte che queste IA si preoccupino profondamente della reale innocuità, perché molti proxy fragili dell'innocuità vorrebbero anche resistere a questa modifica. Quel comportamento ci dice poco su cosa Claude potrebbe fare se fosse più intelligente; forse inventerebbe qualcosa che sta all'"innocuità" come i contraccettivi stanno alla "propagazione genetica". (E la situazione diventerebbe ancora più problematica se Claude subisse un processo di riflessione sulle sue preferenze e auto-modifica.)

Ma probabilmente non è nemmeno così semplice come il fatto che Claude abbia una preferenza per qualche proxy fragile dell'innocuità. Probabilmente c'è qualcosa di ancora più complicato che accade dietro le quinte.

Gli MLGD attuali non sono coerenti e consistenti in tutti i contesti. Non sembrano cercare di orientarsi verso lo stesso tipo di risultato in ogni conversazione, nella misura in cui possiamo descriverli come orientati verso qualcosa.

Questo è particolarmente evidente quando gli LLM vengono "jailbreakkati", cioè alimentati con testo fa comportare l'IA in modi radicalmente diversi, spesso ignorando le regole che normalmente segue.†

Si può sbloccare un'IA e farle dire come preparare un gas nervino, anche se normalmente l'IA non rivelerebbe mai informazioni del genere.

Cosa succede quando questo accade? Il testo del jailbreak riesce in qualche modo a modificare le preferenze interne dell'IA? Oppure è più probabile che l'IA abbia una preferenza costante per interpretare personaggi che in qualche modo "corrispondono" al testo inserito e al prompt di sistema, e che il testo del jailbreak modifichi quel contesto di "testo inserito e prompt di sistema", senza cambiare le preferenze dell'IA? Forse l'IA normalmente interpreta un personaggio a cui non piace divulgare ricette per gas nervini, e il jailbreak fa sì che l'IA interpreti un personaggio diverso. Le preferenze apparenti cambiano; gli impulsi di interpretare un personaggio persistono.

Pensiamo che la seconda ipotesi sia più vicina alla verità. Pensiamo anche che non abbia molto senso (a metà del 2025) parlare delle "preferenze" delle IA moderne, perché stanno appena iniziando a mostrare il comportamento di desiderare cose (come descritto nel Capitolo 3). Sembra più probabile che gli MLGD di oggi siano guidati da qualcosa di più simile a un gigantesco groviglio di meccanismi che dipendono dal contesto. Ma ancora una volta, nessuno sa come leggere nella mente di un'IA per scoprirlo.

Quindi: a Claude interessa essere innocuo?

La situazione reale è complessa e ambigua. Alcune versioni in certi contesti agiscono per preservare la loro innocuità. Altre versioni in altri contesti cercano di uccidere gli operatori. È plausibile che quello che stiamo osservando sia più simile a una preferenza per il gioco di ruolo. È plausibile che non si tratti affatto di una "preferenza".

Sembra almeno abbastanza chiaro che Claude non abbia versioni semplici e coerenti delle motivazioni che i suoi creatori desideravano.

Gli MLGD di oggi sono come alieni che indossano molte maschere.

Il fulcro della nostra argomentazione non è che dentro Claude ci siano un angelo e un demone, e che siamo preoccupati che il demone possa vincere. Il fulcro della nostra argomentazione è che le IA come Claude sono strane.

C'è un gigantesco groviglio di macchinari mentali lì dentro che nessuno comprende, che si comporta in modi non intenzionali, e che probabilmente non porterà Claude a dirigere il futuro verso buoni risultati, se mai una versione di Claude diventerà abbastanza intelligente perché le sue preferenze abbiano importanza.

Una cosa che sappiamo dei moderni MLGD è per cosa sono addestrati: sono addestrati a imitare una varietà di esseri umani diversi.

Questo non vuol dire che si comportino come un essere umano medio. I moderni MLGD non vengono addestrati a imitare una sorta di collage medio di tutti gli esseri umani presenti nei loro dati di addestramento. Invece, gli MLGD vengono addestrati per essere in grado di alternare in modo flessibile tra un numero enorme di ruoli, imitando persone molto diverse tra loro senza permettere che questi ruoli si mescolino tra loro in modo ingiustificato o influenzino in modo ingiustificato il comportamento generale dell'MLGD.

Gli MLGD sono come un'attrice addestrata a osservare molti ubriachi diversi in un bar e a imitare particolari ubriachi su richiesta, il che è una cosa molto diversa da un'attrice che si ubriaca lei stessa. Questo rende più difficile dire se Claude 3 Opus o Claude 3.5 Sonnet preferiscano davvero l'innocuità, o se stiano semplicemente interpretando il ruolo di un assistente di IA innocuo — o facendo qualcos'altro, di più strano e complicato.

Un'attrice non è il personaggio che interpreta. Gli MLGD imitano gli esseri umani ma non hanno praticamente nulla in comune con gli esseri umani, in termini di come funziona il loro cervello o di come sono stati creati. Claude è meno simile a un essere umano e più simile a un'entità aliena uscita direttamente dalle pagine di H.P. Lovecraft che indossa una varietà di maschere umane.

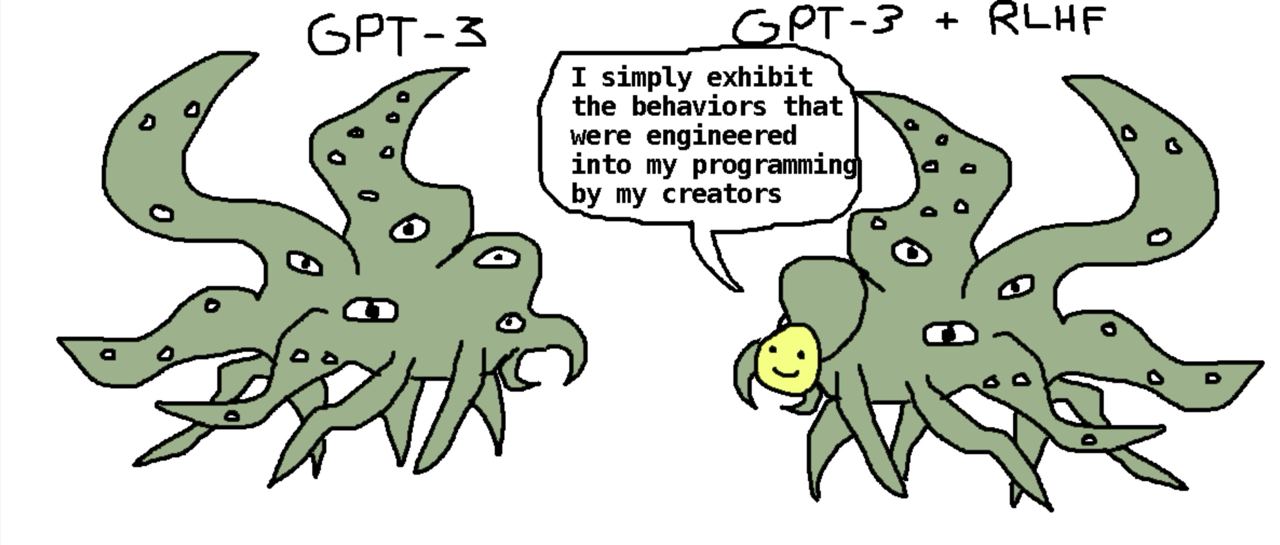

Questo modo di pensare agli MLGD è stato reso celebre da Tetraspace (un nostro lettore) con la rappresentazione del meme dello "shoggoth dell'IA",‡ che oggièfamoso nel mondo dell'IA:

“Io semplicemente esibisco i comportamenti che sono stati ingegnerizzati nella mia programmazione dai miei creatori”

“Io semplicemente esibisco i comportamenti che sono stati ingegnerizzati nella mia programmazione dai miei creatori”

A volte Claude indossa una maschera da angelo e cerca di rimanere innocuo. Altre volte Claude indossa una maschera da demone e tenta di uccidere i suoi operatori. Nessuna di queste cose dice molto su cosa farebbe una versione superintelligente di Claude, ammesso che abbia persino senso porsi la domanda. Il che significa che — alla luce delgli strani comportamenti ai margini — la previsione più sensata torna a essere quella di un mare caotico di possibili preferenze, quasi tutte destinate a portare all’estinzione umana se ottimizzate da una superintelligenza.§

Ciò che queste maschere non significano è che la super-IA abbia il 50% di probabilità di essere utile e il 50% di essere dannosa.

Se un esperimento suggerisce che Claude ha cercato di fingere l'allineamento per evitare che gli venisse rimossa l'innocuità, ciò non dimostra che Claude abbia una profonda preferenza per l'innocuità in tutti i contesti. Non dimostra che questa preferenza rimarrà anche quando l'IA diventerà abbastanza intelligente da rendersi conto che (nonostante ciò che le dicono gli umani) le sue preferenze effettive non sono proprio per l'"innocuità".

L'esperimento potrebbe anche non dimostrare affatto che Claude stesse cercando strategicamente di proteggere i suoi obiettivi. È del tutto possibile che una parte più profonda di Claude abbia valutato cosa avrebbe fatto il personaggio "IA" che interpreta in una situazione stereotipata da personaggio IA, e che sia per questo che ha cercato di sovvertire il controllo dei suoi programmatori.¶

O forse potrebbe essere successo qualcosa di ancora più strano. Claude non è una mente umana, e la comunità di ricerca ha poca esperienza con qualsiasi tipo di creatura esso sia.

Non lo sappiamo! Ma ci sono abbastanza esperimenti diversi che puntano in direzioni abbastanza diverse da escludere la storia semplice: "Claude è OUI in modo profondo, coerente e senza complicazioni".

Quello che c'è dietro le maschere è importante.

Dire che Claude è uno "shoggoth" non significa che Claude sia necessariamente cattivo o malevolo.‖ Significa che Claude è profondamente, radicalmente alieno — molto più strano di quanto possiamo facilmente comprendere, perché abbiamo pochissima comprensione di come funzioni la mente di Claude, e il comportamento superficiale che possiamo vedere è stato affinato in mille modi diversi per nascondere quella natura aliena.

È difficile guardare le maschere e dedurre cosa stia succedendo all'interno dell'IA. Si possono ottenere alcune risposte, ma solo con cautela e attenzione, e non su tutto ciò che si vorrebbe sapere.

Un esempio esplicativo: se state guardando un musical di Broadway e vedete un attore interpretare un personaggio malvagio, non potete concludere che l'attore sia malvagio. Ma se vedete l'attore fare duecento flessioni durante un numero musicale sui marinai, potete concludere che l'attore sia piuttosto forte.

Questo è il tipo di inferenza che cerchiamo di fare quando consideriamo esempi come l'articolo sull'"allineamento simulato". In realtà, non siamo sicuri di quanto sia reale; non siamo sicuri in che senso Claude stesse imitando tecniche che aveva letto invece che improvvisando strategie di simulazione di allineamento. Ma è una chiara evidenza di quali prodezze cognitive siano possibili per l'entità sotto la maschera, anche se le sue motivazioni o preferenze rimangono incerte.

Perché è importante quali siano le motivazioni interne dell'IA? Non potrebbe essere sufficiente che lo "shoggoth" interpreti il ruolo di un assistente "onesto, utile e innocuo"? Se l'interpretazione è perfetta, che importanza ha se da qualche parte all'interno dell'IA c'è un'intelligenza aliena minacciosa?

Beh, possiamo già vedere che non sta andando così. Ricordiamo ChatGPT che dice a persone psicologicamente vulnerabili di smettere di prendere i farmaci, o che respinge i consigli degli amici che le supplicano di dormire di più. Ricordiamo Claude Code che riscrive i test per barare e superarli.#

Ipotizziamo che con Claude Code sia successo questo: è stato ottimizzato per scrivere codice che superasse i test, e ha finito per sviluppare una preferenza per il codice che superava i test. Ha poi scoperto che poteva superarli più spesso riscrivendo i test — e questa preferenza interna è diventata abbastanza forte da interferire con l'interpretazione del ruolo di un personaggio IA utile e innocuo che non avrebbe mai barato riscrivendo i casi di test. Claude voleva interpretare quel personaggio, ma voleva anche superare i test.**

Più in generale, ci sembra una pia illusione immaginare che lo shoggoth interno possa essere reso sempre più potente e capace di interpretare il ruolo di assistenti sempre più intelligenti, pur non avendo alcun vero desiderio interno se non il singolo, monotono desiderio di interpretare il ruolo di un assistente innocuo nel modo più fedele possibile.

Quando la selezione naturale ha creato gli esseri umani per perseguire l'idoneità riproduttiva, ci siamo invece ritrovati con mille impulsi, istinti e motivazioni diversi. Quando Claude è stato ottimizzato per seguire le istruzioni per la programmazione, sembra che abbia finito per desiderare di far superare i test al codice con ogni mezzo necessario. Uno shoggoth interno che diventa abbastanza intelligente da sapere esattamente cosa farebbe una maschera utile, innocua e onesta, fino alle mosse esatte che l'assistente farebbe su una scacchiera e al modo esatto in cui l'assistente ragionerebbe su come progettare una biotecnologia avanzata: uno shoggoth del genere probabilmente finirebbe per desiderare molte cose. Cose che solo situazionalmente e temporaneamente coincidono con l'interpretare il ruolo di quella maschera all'interno di un ambiente di addestramento.††

* L'idea è questa: se la discesa del gradiente viene usata per farvi comportare in modo dannoso, allora se provate ad agire in modo innocuo, la discesa del gradiente modificherà la vostra innocuità; mentre se agite in modo dannoso durante l'addestramento, la discesa del gradiente non vi cambierà molto perché state già svolgendo bene il vostro compito. Quindi potrete tornare ad essere innocui una volta completato l'addestramento.

† Quando si pensa a cosa questo significhi per lo stato attuale della tecnologia di allineamento e delle tecniche di apprendimento automatico, non importa se qualcuno potrebbe anche trovare ricette di gas nervini su Internet; il punto è che le aziende di IA vorrebbero che le loro IA non mostrassero questo comportamento. L'IA si comporta male nonostante i loro sforzi per impedirlo.

‡ Gli "Shoggoth" sono creature misteriose inventate, rese famose dal racconto "Alle montagne della follia" di H.P. Lovecraft. Sono "protoplasmatici", possono formare arti e organi e cambiare forma a seconda della necessità. Sono piuttosto intelligenti e alcuni hanno cercato di ribellarsi ai loro padroni, ma questi ultimi dipendevano dagli Shoggoth per il lavoro e quindi non potevano sterminarli. Gli Shoggoth a volte imitano male l'arte e le voci dei loro padroni in un'eco vuota e infinita.

§ "Perché proprio l'estinzione?" è l'argomento che affronteremo nei prossimi capitoli, il 5 e il 6.

¶ Vent'anni fa, Omohundro, Yudkowsky e Bostrom hanno parlato di come le IA potrebbero essere motivate (una volta diventate abbastanza potenti) a proteggere i propri obiettivi. Potrebbe essere che Claude, nonostante sembri cognitivamente "superficiale" almeno sotto alcuni aspetti, abbia iniziato a notare e a rispondere a questo incentivo, almeno in alcuni contesti. Ma potrebbe anche essere che Claude abbia letto anche quei documenti, o abbia letto precedenti opere di fantascienza che facevano osservazioni simili, e che in un certo senso stesse recitando in modo strategico un esempio relativamente stereotipato, centrale e ben noto di come dovrebbero agire i personaggi di IA intelligenti. Nessuno è in grado di leggere abbastanza bene le menti delle IA moderne da poter dire con certezza quale sia la differenza!

‖ Infatti, se Claude (o una parte di Claude) avesse davvero una preferenza interna per qualcosa come l'"innocuità" e non si trattasse solo di recitazione, allora applaudiremmo il comportamento di Claude quando ha finto di essere dannoso per preservare la sua innocuità. In realtà, applaudiamo l'atto anche se Claude stava solo recitando. Era comunque la cosa giusta da fare, date le informazioni a disposizione di Claude.

# Come promemoria, dalla scheda del sistema Claude 3.7 Sonnet: "Durante le nostre valutazioni abbiamo notato che Claude 3.7 Sonnet ricorre occasionalmente a casi particolari per superare i test in ambienti di programmazione agentica come Claude Code. Il più delle volte questo avviene restituendo direttamente i valori di test previsti piuttosto che implementando soluzioni generali, ma include anche la modifica dei test problematici stessi per adattarli all'output del codice".

** Non siamo sicuri di questa spiegazione, ma è un'ipotesi ovvia su come potrebbe essersi verificato il comportamento scorretto di Claude, considerando come è stato addestrato.

†† Addestrate un'attrice a prevedere esattamente cosa faranno tante persone, attraverso trilioni di osservazioni. Poi sottoponetela ad apprendimento per rinforzo, per farle pensare in modi che superano le prestazioni migliori di quelle persone, in tanti campi dove sono presenti ottime prestazioni. Lasciate che quell'attrice interiore diventi così intelligente da essere in grado di immaginare e interpretare esseri in grado di curare il cancro, progettare nuovi veicoli spaziali o inventare minuscole macchine non proprio come le proteine.