Nanotecnologia e sintesi proteica

L'intelligenza umana ci ha fornito molti vantaggi rispetto alle altre specie. Uno dei più rilevanti, tuttavia, è stata la nostra capacità di inventare nuove tecnologie. Se gli sviluppatori proseguono nella corsa e costruiscono un'IA più intelligente dell'uomo, possiamo analogamente aspettarci che gran parte del potere dell'IA provenga dalla sua capacità di far avanzare le frontiere scientifiche e tecnologiche. Ma cosa significa questo, concretamente? Quali tecnologie non ancora inventate non aspettano che di essere scoperte?

È una domanda difficile a cui rispondere in termini generali. Uno scienziato nel 1850 avrebbe avuto enormi difficoltà a immaginare molte delle invenzioni dei successivi cento anni.

Tuttavia, non sarebbero stati completamente impotenti. Gli scienziati hanno previsto molte invenzioni decenni o secoli prima che fossero costruite, nei casi in cui una tecnologia poteva essere analizzata tecnicamente prima che gli ingegneri riuscissero a mettere insieme tutti i pezzi.*

Una delle frontiere tecnologiche più impattanti che riteniamo l'IA probabilmente esplorerà è lo sviluppo di strumenti e macchine estremamente piccoli. Di seguito, entreremo in alcuni dettagli su questo argomento e sul ragionamento che vi sta dietro.

L'esempio della biologia

Ogni cellula di ogni organismo in natura contiene un'enorme varietà di macchinari intricati.

"Macchinari" qui non è solo una metafora. Le macchine in questione sono piccole, quindi funzionano in modo un po' diverso rispetto alle macchine della vostra vita quotidiana. Ma molte macchine su larga scala hanno analoghi all'interno del nostro corpo. L'ATP sintasi genera energia nel corpo in modo simile a una ruota idraulica, utilizzando un flusso di protoni per far letteralmente girare un rotore.

[embed video or gif: https://en.wikipedia.org/wiki/File:ATP_synthesis_-_ATP_synthase_rotation.ogv]

Il flagello batterico funziona in modo simile all'elica di una barca, completo di un intero motore che fa ruotare il flagello per spingere il batterio attraverso i liquidi:

[embed video: https://www.youtube.com/watch?v=cwDRZGj2nnY]

Un altro esempio, che abbiamo citato nel libro, è la kinesina, una piccola proteina che funziona come un robot trasportatore. Le kinesine "camminano" lungo fibre autoassemblanti che attraversano i neuroni, trasportando i neurotrasmettitori alla loro destinazione.

[embed video o gif: https://www.youtube.com/watch?v=y-uuk4Pr2i8]

Più piccola è una macchina, più velocemente può funzionare, in genere; e le macchine piccole come le molecole funzionano molto velocemente. Le kinesine fanno fino a 200 passi al secondo, andando avanti con un "piede" mentre l'altro piede rimane saldamente ancorato al microtubulo su cui si trova.†

Una delle frontiere tecnologiche che l'intelligenza artificiale più intelligente dell'uomo potrebbe esplorare è la costruzione, la progettazione o il riutilizzo di macchine su scala molto piccola. Questo tipo di tecnologia potrebbe essere classificata come "biotecnologia", "nanotecnologia" o qualcosa di intermedio, a seconda di fattori quali la scala, quanto il design assomigli alle strutture biologiche esistenti, e se sia "umida" (dipendente dall'acqua, come i meccanismi delle cellule viventi) o "secca" (in grado di funzionare all'aria aperta).

Pensare agli organismi biologici come a meraviglie dell'ingegneria su scala nanometrica può aiutare a formulare ipotesi su ciò che le IA più intelligenti degli umani potrebbero essere in grado di realizzare con una scienza e una tecnologia più avanzate di quelle che possediamo oggi.

(C'è poi la questione di quanto tempo ci vorrebbe per inventare e sviluppare una tecnologia del genere. Per saperne di più, date un'occhiata al capitolo 1 del libro, dove si parla di come le superintelligenze artificiali potrebbero pensare almeno 10.000 volte più velocemente degli esseri umani con l'hardware dei computer di oggi. Si veda anche la nostra discussione approfondita su come le IA dovrebbero dedicare un po' di tempo all'esecuzione di test fisici ed esperimenti, ma il rallentamento complessivo probabilmente non costituirebbe un ostacolo significativo per una superintelligenza.)

Considerando le imprese degli ingegneri umani di oggi, può sembrare difficile credere che, ad esempio, un'intelligenza artificiale con capacità superumane che gestisce un laboratorio biologico possa mai costruire fabbriche microscopiche che usano la luce solare per autoreplicarsi continuamente. Potrebbe sembrare ancora più fantastico immaginare microfabbriche universali, fabbriche in grado di accettare istruzioni per costruire praticamente qualsiasi macchina con le risorse disponibili.

Ma macchine del genere non solo sono possibili, esistono già. Le alghe sono fabbriche grandi pochi micron, alimentate dal sole e capaci di autoreplicarsi, che possono raddoppiare la loro popolazione in meno di un giorno. E le alghe contengono ribosomi, che sono la versione biologica di una stampante 3D universale o di una catena di montaggio universale (universale almeno per quanto riguarda gli elementi costitutivi della vita).

Con le giuste istruzioni (codificate nell'RNA messaggero), i ribosomi stampano strutture arbitrarie che possono essere assemblate dalle proteine. Questa universalità è alla base dell'enorme complessità e varietà del mondo biologico: tutta la diversità della vita sulla Terra, in definitiva, viene assemblata da queste fabbriche universali, che sono presenti essenzialmente immutate in tutto, dai porcospini ai moscerini della frutta ai batteri.

[embed video: https://www.youtube.com/watch?v=8dsTvBaUMvw]

I ribosomi possono anche essere utilizzati per assemblare strutture che non sono esse stesse costituite da proteine, utilizzando le proteine come intermediario. Un esempio di struttura non proteica che i ribosomi possono costruire in questo modo è l'osso. I ribosomi producono proteine che si ripiegano in enzimi debolmente legati che catalizzano calcio e fosforo trasformandoli in reagenti speciali. Questi reagenti formano quindi una matrice di collagene che guida il calcio e il fosforo nella posizione corretta per trasformarli in osso duro e cristallino.

La natura fornisce una prova concreta che alcune macchine fisiche davvero straordinarie sono possibili, per entità abbastanza intelligenti da utilizzare i ribosomi in modi che gli esseri umani non hanno ancora scoperto — o entità che utilizzano i ribosomi per costruire i propri analoghi migliorati dei ribosomi.

Ma le strutture che vediamo nel mondo biologico stabiliscono solo un limite inferiore per ciò che è possibile. Gli organismi biologici sono ben lontani dai limiti teorici dell'efficienza energetica e della resistenza dei materiali, e potrebbero essere relativamente facili da migliorare per ragionatori molto più intelligenti degli esseri umani.

Tanto spazio in basso

Se vi sembra strano utilizzare i fenomeni naturali come evidenza di quali tecnologie future potrebbero essere possibili, notate che questo è uno schema comune nella storia della scienza. Gli uccelli potevano volare, quindi gli inventori hanno trascorso secoli cercando di costruire macchine volanti.

Richard Feynman, un fisico pionieristico, ha dimostrato la potenza di questo approccio in una conferenza del 1959 intitolata "C'è molto spazio in basso". Nella conferenza, Feynman esegue calcoli su quali tipi di cose interessanti si potrebbero fare con la miniaturizzazione.

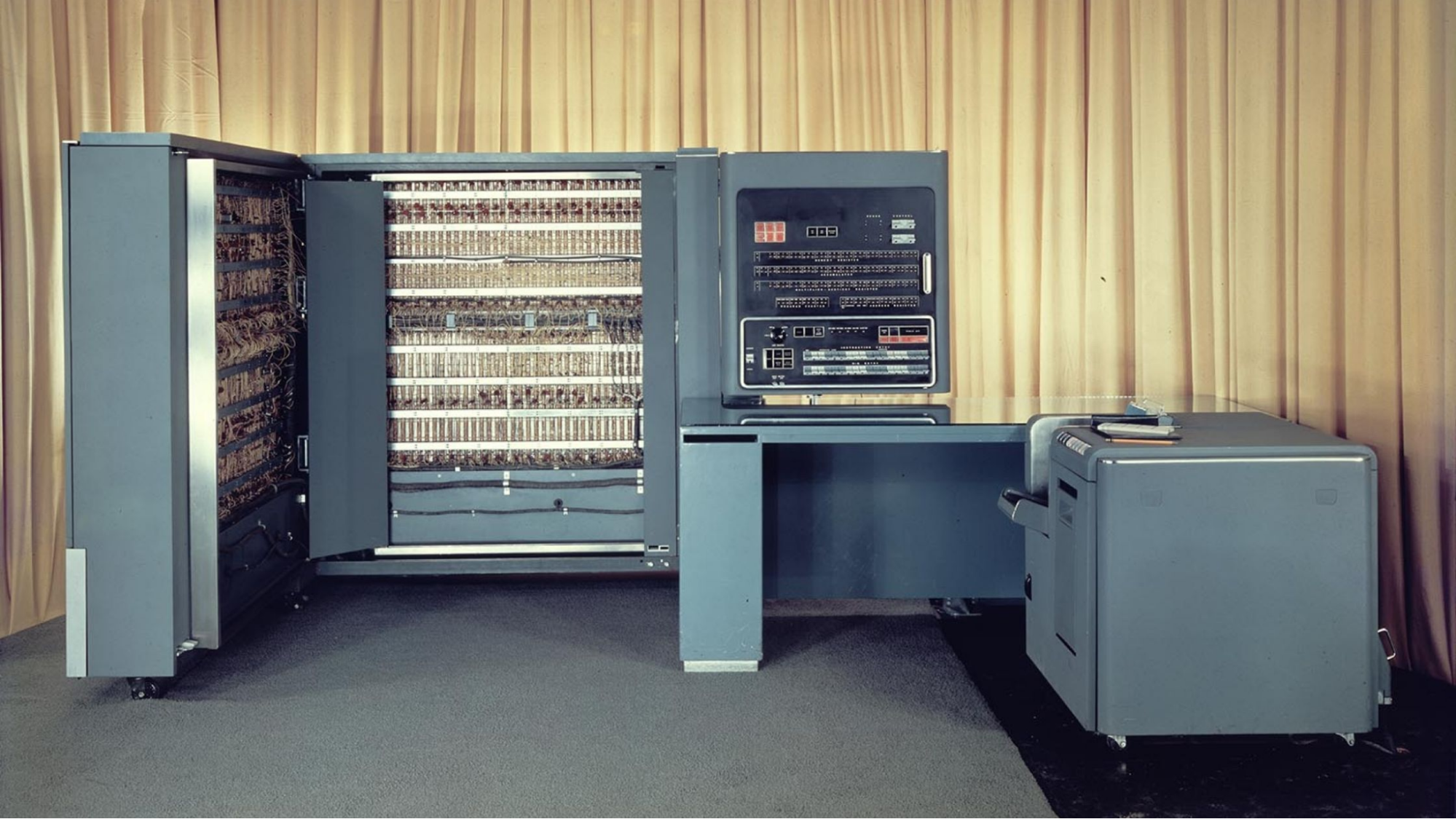

Oggi, le osservazioni di Feynman suonano straordinariamente profetiche. Feynman nota che i computer potrebbero probabilmente fare molto di più se contenessero un numero maggiore di componenti, ma che l'ostacolo a ciò è quanto grandi dovrebbero diventare. Bisogna miniaturizzarli!

Feynman calcola che ci vorrebbe circa un petabit (1.000.000.000.000.000 di bit) per memorizzare tutti i libri scritti dall'umanità:

Per ogni bit concedo 100 atomi. E si scopre che tutte le informazioni che l'uomo ha accuratamente accumulato in tutti i libri del mondo possono essere scritte in questa forma in un cubo di materiale largo un duecentesimo di pollice — che è il più piccolo granello di polvere che può essere distinto dall'occhio umano. Quindi c'è molto spazio in basso! Non parlatemi di microfilm!

Oggi non ci siamo ancora riusciti! L'elemento di archiviazione effettivo all'interno di una scheda microSD da 2 terabyte misura ancora 0,6 millimetri per lato. Per confronto, 1/200 di pollice corrisponderebbe a 0,125 mm per lato. E la scheda SD contiene appena 17,6 trilioni di bit, che rappresenta solo 1/57 di quanto Feynman aveva calcolato nel 1959 come necessario per memorizzare tutta la conoscenza dell'umanità.

Forse Feynman si sbagliava sui limiti ultimi dell'ingegneria in senso pratico? Negli ultimi tempi, i progressi nella miniaturizzazione informatica hanno subito un forte rallentamento. Dire che qualcosa è fisicamente possibile non dimostra che gli ingegneri riusciranno a realizzarlo.

E arrivare a un risultato entro tre ordini di grandezza da ciò che un giorno sarebbe stato effettivamente raggiunto può essere considerato un notevole colpo di previsione da parte di Feynman. Feynman tenne la sua conferenza sei anni prima che Gordon Moore formulasse per la prima volta l'idea che oggi chiamiamo Legge di Moore. La gente non era abituata a pensare alla miniaturizzazione come a una legge ineluttabile su un grafico. Non sappiamo di nessun altro ai tempi di Feynman che abbia ipotizzato che un giorno potesse esistere un dispositivo il cui elemento di memoria, grande come un granello di sabbia, potesse contenere dieci milioni di volte più informazioni dei più grandi computer a valvole degli anni '50.

Fonte immagine:IBM

Fonte immagine:IBM

Ma in realtà Feynman non si sbagliava. E Feynman sapeva già allora che la sua stima era sicura:

Questo fatto, cioè che si possono avere un sacco di informazioni in uno spazio super piccolo, è ovviamente ben noto ai biologi [...] tutte queste informazioni sono contenute in una piccolissima parte della cellula sotto forma di molecole di DNA a catena lunga, dove circa cinquanta atomi sono usati per un bit di informazione sulla cellula.

I computer moderni non sono ancora stati miniaturizzati fino a raggiungere la scala del DNA, ma in sessant'anni ci siamo avvicinati notevolmente. I transistor dei chip commerciali di fascia alta hanno ora una larghezza inferiore a cento atomi e sono costruiti con una tecnologia che consente di aggiungere strati di materiale dello spessore di un singolo atomo.

Basarsi su analogie naturali e calcoli approssimativi si è rivelato un modo super efficace per capire cosa si sarebbe potuto fare nei decenni a venire. E queste traiettorie tecnologiche possono andare molto più veloci quando l'intelligenza artificiale fa il lavoro scientifico e ingegneristico necessario.

Superare la biologia

Perché la carne non può essere forte come l'acciaio?

Dopotutto, si tratta degli stessi atomi. I legami metallici tra gli atomi di ferro sono forti, ma lo sono anche i legami covalenti tra gli atomi di carbonio nel diamante; perché non ci siamo evoluti per avere una maglia di diamante che attraversa la nostra pelle, per aiutarci a sopravvivere fino all'età riproduttiva?

Del resto, se il ferro è così resistente, perché gli organismi non si sono evoluti per mangiare minerale di ferro e sviluppare una pelle rivestita di ferro? Se gli ingegneri umani riescono a farlo, perché la natura non l'ha fatto prima?

Forse c'è qualche motivo situazionale per cui le pelli rivestite di ferro in particolare non sono una grande idea.

Ma se non quello, perché non qualcos'altro?

La grande domanda generale qui è: perché la natura è così lontana dai limiti delle possibilità fisiche — come calcolate dalla fisica o dimostrate dall'ingegneria umana? Non c'è una risposta profonda e generale, e non solo una limitata e superficiale?

Abbiamo notato che Feynman è riuscito a usare le strutture della biologia per stabilire dei limiti inferiori a ciò che dovrebbe essere possibile con maggiori conoscenze scientifiche. Ma in molti casi, la tecnologia umana ha già superato la biologia. Come mai è possibile, quando l'evoluzione ha avuto miliardi di anni per perfezionare piante e animali? Comprendere questo fenomeno generale può aiutare a far luce sul perché la nanotecnologia sia probabilmente in grado di andare ben oltre ciò che possiamo già vedere oggi in natura.

Possiamo immaginare di trovarci in un mondo dove le sequoie sono alte almeno la metà degli edifici più alti. Possiamo immaginare un mondo dove la pelle degli animali più resistenti è dura almeno la metà dei materiali più duri osservati. Perché non ci troviamo in un mondo simile, dove la natura si è spinta contro i limiti fisici dopo qualche miliardo di anni di evoluzione?

È una domanda abbastanza profonda da non permetterci di riassumere brevemente tutto ciò che è noto. Ma il riassunto generale è che la selezione naturale ha difficoltà ad accedere ad alcune parti dello spazio di progettazione, incluse molte parti che sono molto più facili da raggiungere se si è un ingegnere umano.

I tre fattori principali che vediamo contribuire a questo sono:

- La selezione naturale ha una pressione selettiva limitata e ci vogliono centinaia di generazioni per far sì che una nuova mutazione diventi universale. Se una caratteristica biologica non è molto, molto antica, spesso sembra progettata in fretta e furia, come se il tempo stringesse.

- Tutto ciò che è stato costruito dalla selezione naturale ha avuto origine come errore accidentale in un progetto precedente — una mutazione. L'evoluzione ha maggiori difficoltà a esplorare parti dello spazio progettuale che sono distanti da ciò che attualmente esiste negli organismi. È difficile per l'evoluzione superare le lacune.

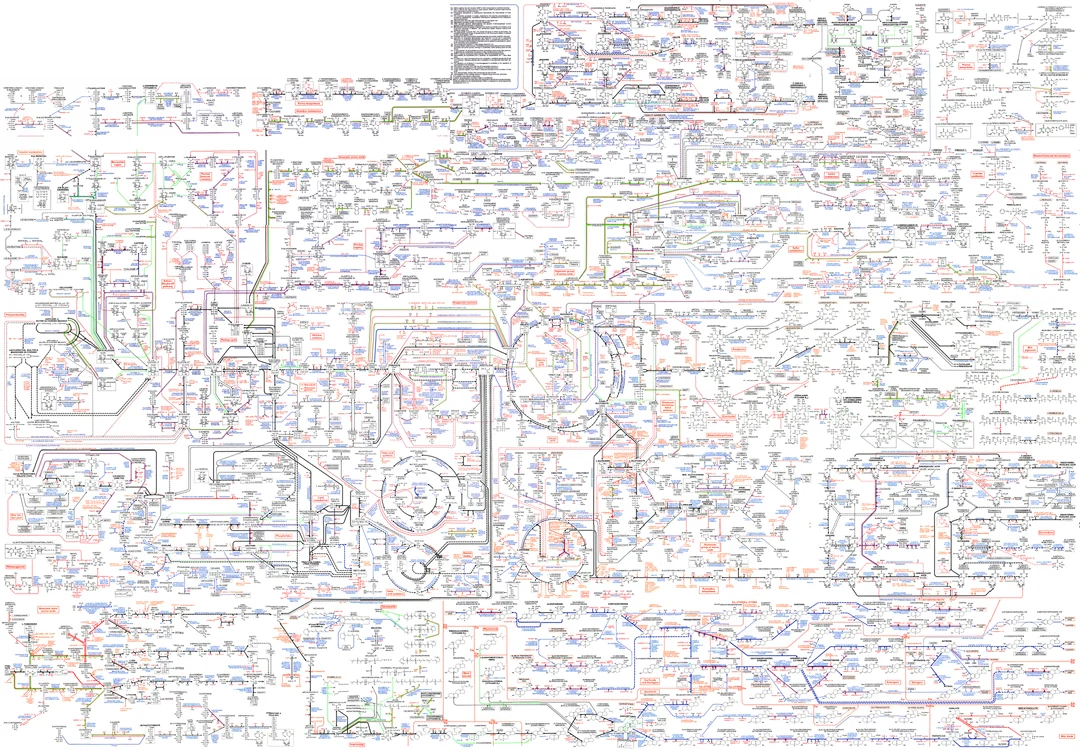

- La selezione naturale ha difficoltà a costruire cose nuove o a risolvere problemi che richiederebbero cambiamenti simultanei anziché sequenziali. Questo limita drasticamente i progetti che l'evoluzione può realizzare e conferisce ai progetti attuali in biologia il loro aspetto frammentario, approssimativo ed estremamente intricato secondo gli standard dell'ingegneria umana. Ad esempio, la complessità (delle parti conosciute) del metabolismo umano:

Fonte immagine:Reddit

Fonte immagine:Reddit

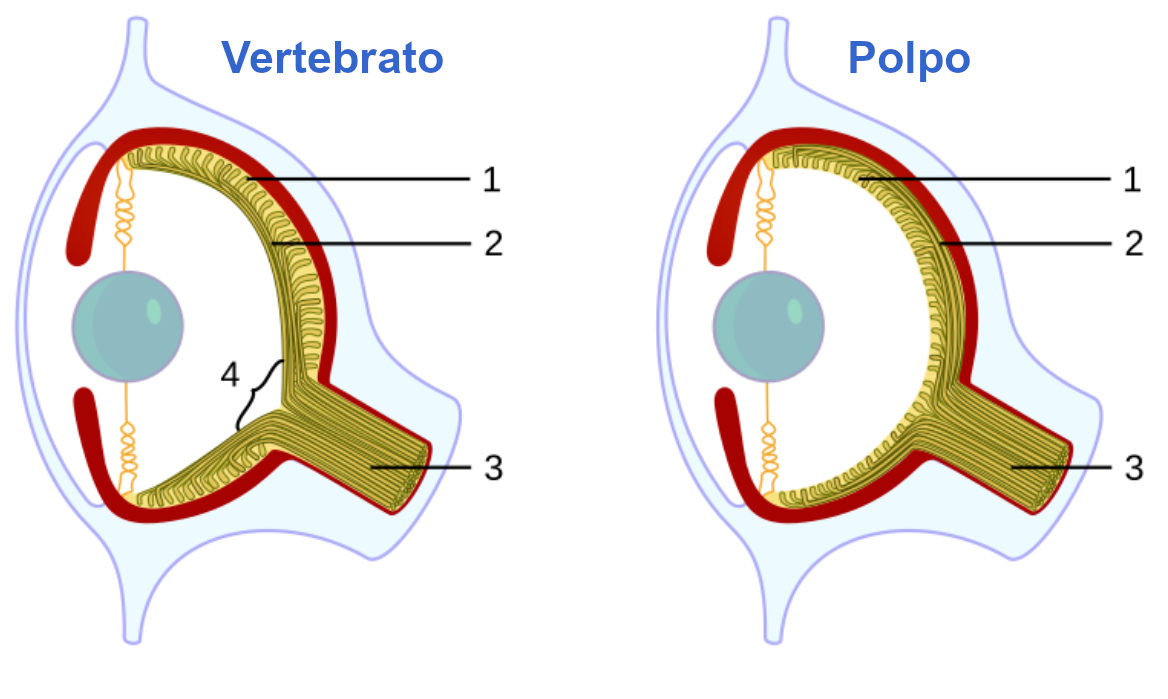

Oppure, per un esempio più semplice della confusione evolutiva, consideriamo l'occhio. Gli occhi dei vertebrati si sono evoluti casualmente con i nervi (2 nell'immagine sotto) posizionati sopra le cellule fotosensibili (1). Questi nervi devono uscire dall'occhio attraverso un foro nella parte posteriore (3) e, dato che questo punto presenta un foro, deve necessariamente essere privo di cellule fotosensibili. Questo crea un punto cieco (4) per tutti i vertebrati, compresi gli esseri umani, costringendo il cervello a escogitare trucchi intelligenti per "riempire" il vuoto (ad esempio, utilizzando le informazioni dell'altro occhio).

I polpi hanno evoluto gli occhi in modo indipendente e, casualmente, sono arrivati al design più ragionevole — i nervi passano dietro le cellule fotosensibili. Questo permette a questi collegamenti di uscire dall'occhio senza creare alcun punto cieco.

Fonte immagine:Wikipedia

Fonte immagine:Wikipedia

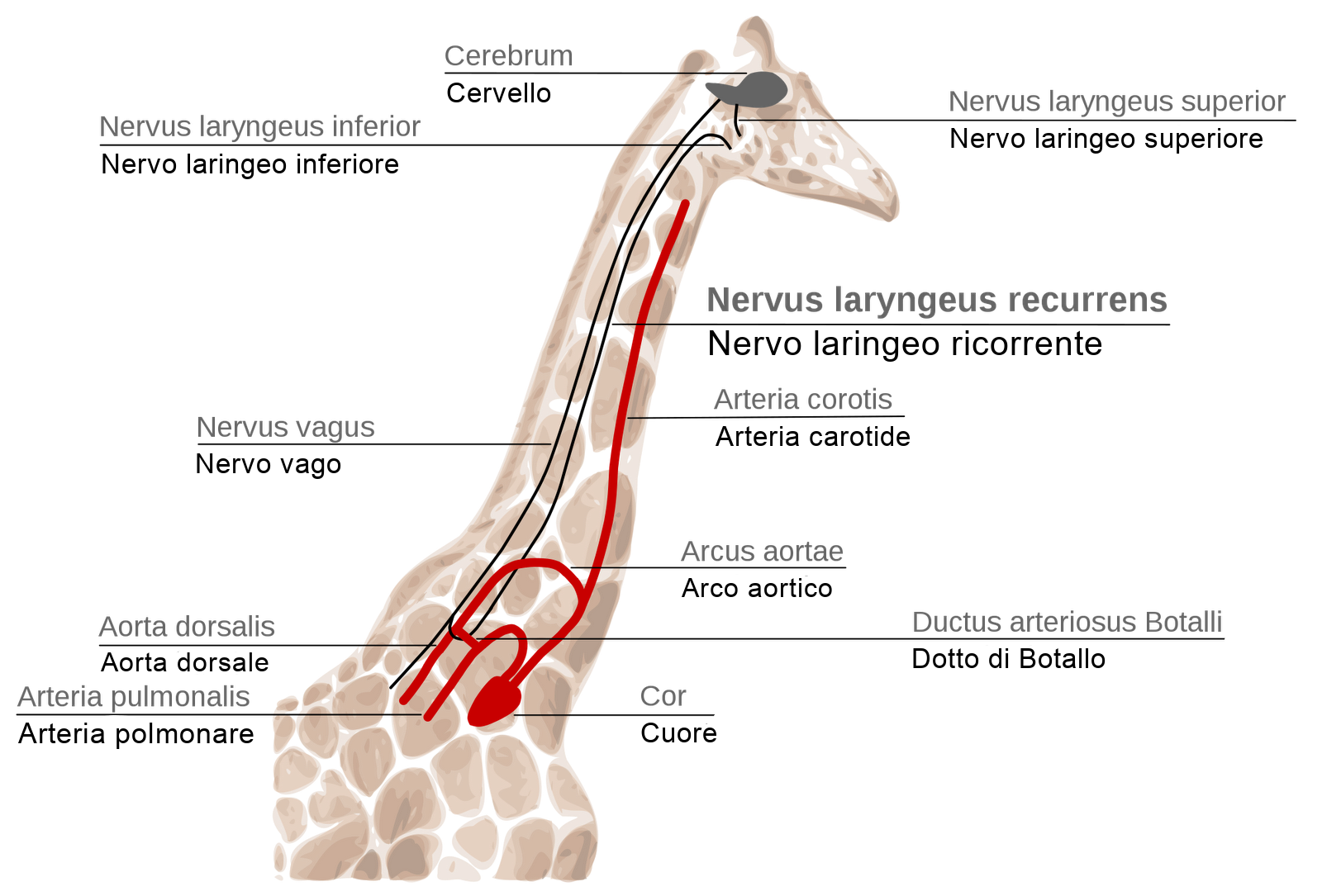

Oppure consideriamo il nervo laringeo ricorrente della giraffa, che deve collegare la gola della giraffa al suo cervello per azionare la laringe. Anziché prendere il percorso diretto, questo nervo parte dalla gola, scende per tutta la lunghezza del collo della giraffa, fa un giro goffo intorno all'aorta della giraffa, risale per tutto il collo fino a tornare al punto di partenza, e poi si collega al cervello.

Il risultato è un nervo lungo quattro metri e mezzo (l'anello nero nell'immagine sotto), che fa sì che i segnali impieghino da dieci a venti volte più tempo del necessario per viaggiare tra il cervello della giraffa e la sua gola.

Fonte immagine: Wikipedia

Fonte immagine: Wikipedia

Nei pesci, questo design aveva senso perché la loro versione del nervo laringeo collegava il cervello alle branchie — un collegamento diretto. Se si prende lo stesso design e si dà all'animale un collo, continuando però ad allungare il collo senza mai rifare il cablaggio da capo, si ottengono design molto inefficienti. Compatibili con la sopravvivenza, ma inefficienti.

L'evoluzione produce design fantastici, se ha abbastanza tempo. Ma gli esseri umani e le IA possono inventare una gamma di design molto più varia e flessibile, e possono farlo molto velocemente.

I primi organismi multicellulari con cellule differenziate e specializzate sembrano essersi evoluti circa 800 milioni di anni fa. In termini umani, sembra un'eternità. Ma l'evoluzione funziona molto più lentamente della civiltà umana.

Un gene appena mutato che dà un vantaggio del 3 % nella capacità riproduttiva (che è un sacco per una mutazione!) ci metterà in media 768 generazioni per diffondersi in una popolazione di 100.000 organismi che si riproducono tra loro. Se la popolazione è di 1.000.000 di individui (la stima della popolazione umana ai tempi dei cacciatori-raccoglitori), ci vorranno 2.763 generazioni. E la probabilità che la mutazione si diffonda fino a diventare fissa, invece di scomparire casualmente, è solo del 6%.

Nella genetica delle popolazioni, la regola generale è "una mutazione, una morte". Se gli errori di copia del DNA introducono dieci copie di una mutazione dannosa in ogni nuova generazione, allora dieci portatori di quella mutazione devono morire o non riuscire a riprodursi, per generazione, al fine di controbilanciare la pressione del semplice rumore genetico.

Non è così grave come sembra, come costo per mantenere le informazioni genetiche. In una specie che si riproduce sessualmente, si può ottenere una persona (o un embrione) che porta un sacco di mutazioni dannose e che muore - o non riesce a riprodursi, o abortisce - e questo può eliminare più di un caso di gene mutato alla volta. Ma questo limite è ancora la spiegazione standard del perché gli esseri umani abbiano perso così tanti diversi adattamenti utili che si riscontrano negli scimpanzé e in altri primati. Mentre la selezione naturale era impegnata a selezionare una maggiore intelligenza dei primati (per esempio), aveva meno spazio per preservare tutti i sottili geni olfattivi che consentono un senso dell'olfatto più ricco. I geni olfattivi rilevanti erano utili per la sopravvivenza, ma non abbastanza da rimanere mentre l'attenzione dell'evoluzione era altrove.

La maggior parte delle giraffe non muore a causa del loro nervo laringeo assurdamente lungo. Forse alcune giraffe che riescono a soffocare con dei rametti sarebbero sopravvissute se il loro cervello fosse stato in grado di reagire più velocemente, ma probabilmente non è molto comune. Quindi non è proprio una priorità per la selezione naturale, che ha solo una pressione di ottimizzazione limitata da distribuire. Il design approssimativo della giraffa per lo più funziona, viene buttato fuori dalla porta e il gioco è fatto.

In pratica, l'evoluzione non può rifattorizzare i propri progetti né ripartire da zero: può solo apportare piccole modifiche. Ma anche se esistesse un progetto migliore, eliminare queste strane complicazioni aggiuntive e saldare il "debito di progettazione" non è certo una priorità della selezione naturale.

E poiché la selezione naturale non pensa mai al futuro, non diventa una priorità nemmeno se ci fossero altri grandi miglioramenti per la giraffa che si potrebbero ottenere con una struttura del sistema nervoso meno bizzarra. La selezione naturale non pianifica. È semplicemente la storia congelata di quali geni e organismi si sono già riprodotti nella pratica.

Essere in grado di individuare un cattivo design non significa necessariamente che si possa costruire una giraffa migliore. Ma gli esseri umani hanno fatto progressi notevoli in pochissimo tempo quando si tratta di mettere in funzione centinaia di migliaia di macchine che fanno cose che la natura non può fare. Ci aspettiamo che questo valga ancora di più se e quando le IA diventeranno più brave nel design degli esseri umani e saranno in grado di svolgere lo stesso lavoro cognitivo centinaia di migliaia di volte più velocemente.

La capacità della selezione naturale di "progettare" una giraffa migliore è ostacolata dal fatto che opera attraverso mutazioni e ricombinazioni. Ha difficoltà ad accedere a qualunque parte dello spazio dei progetti che non sia raggiungibile attraverso una serie di singole mutazioni — ciascuna delle quali deve essere, individualmente, vantaggiosa — oppure tramite la combinazione di mutazioni che, prese singolarmente, erano già abbastanza vantaggiose da essere presenti in una parte consistente del patrimonio genetico prima di combinarsi.

Un complesso genetico composto da cinque geni, ciascuno con una prevalenza indipendente del 10 % nella popolazione, ha solo una probabilità su 100.000 di assemblarsi all'interno di ciascun organismo. E un complesso genetico che rappresenta un enorme vantaggio, ma solo una volta su 100.000, non ha quasi nessuna possibilità di evolversi fino a fissarsi.

Questo non vuol dire che la selezione naturale non possa creare macchine complesse, ma solo che il suo percorso verso macchinari complessi deve passare attraverso fasi incrementali vantaggiose. Per reindirizzare il nervo della giraffa sarebbero necessari una manciata di cambiamenti simultanei al genoma della giraffa, e ciascuno di questi cambiamenti sarebbe individualmente inutile senza gli altri. Quindi l'anatomia della giraffa rimane così com'è.

La meraviglia dell'evoluzione non sta nella sua rapidità; la sua complessità campionaria è di gran lunga superiore a quella di un ingegnere umano che fa studi di casi. La meraviglia della selezione naturale non sta nell'elegante semplicità dei suoi disegni; basta dare un'occhiata al diagramma di un qualsiasi processo biochimico per sfatare questo malinteso. La meraviglia della selezione naturale non sta nella sua robusta correzione degli errori che copre ogni percorso che potrebbe andare storto; ora che moriamo meno spesso di fame e per lesioni, la maggior parte della medicina moderna si occupa di trattare parti della biologia umana che esplodono in modo casuale in assenza di traumi esterni.

La meraviglia dell'evoluzione è che — come processo di ricerca puramente accidentale — l'evoluzione funziona.

La debolezza delle proteine

Questo ci porta a un altro modo in cui la tecnologia può probabilmente migliorare la biologia.

Molto al di sotto del livello della pelle, invisibili a occhio nudo, ci sono le cellule. Molto al di sotto del livello delle cellule ci sono le proteine.

Le proteine, quando si ripiegano, sono per lo più tenute insieme dall'equivalente molecolare dell'elettricità statica — forze di van der Waals decine o centinaia di volte più deboli dei legami metallici come quello del ferro, o anche dei legami covalenti come quello del diamante.

Perché la biologia usa un materiale così debole come blocco costitutivo di base? Perché un materiale più forte avrebbe reso più difficile il lavoro dell'evoluzione. (E se si rende troppo difficile l'evoluzione, non potrà mai evolversi il tipo di persone che fanno queste domande.)

Le proteine si ripiegano sotto l'azione di forze molecolari relativamente leggere e sono legate in quelle forme principalmente dall'elettricità statica. Questo è uno dei motivi principali per cui la selezione naturale ha una ricca struttura di possibilità circostanti da esplorare: mutazioni casuali possono modificare ripetutamente una proteina e finire per imbattersi in un nuovo design che fa più o meno la stessa cosa, ma leggermente meglio.

Se invece gli organismi fossero costituiti da molecole tenute insieme da legami stretti, cambiare uno dei componenti avrebbe meno probabilità di produrre una nuova struttura interessante (e potenzialmente utile). Potrebbe comunque succedere a volte, ma molto meno spesso. E se siete il tipo di progettista che impiega due miliardi di anni per inventare le colonie cellulari e un altro miliardo di anni per inventare tipi diversi di cellule, "accade meno spesso" significa che la stella più vicina si gonfierà e inghiottirà il vostro pianeta prima che voi arriviate a quel punto.

Ogni proteina esiste a causa di un errore di copia da parte di una proteina precedente. La proteina precedente non era tenuta saldamente insieme da molti legami forti perché sarebbe stato più difficile evolversi da essa. Quindi probabilmente anche l'ultima nuova proteina non ha molti legami forti.

A volte, la biochimica riesce effettivamente a creare legami molto forti. Abbiamo già citato prima l'esempio delle ossa. Un altro esempio si trova nelle piante: queste hanno evoluto proteine che si ripiegano in enzimi, i quali catalizzano la sintesi dei mattoni molecolari che vengono poi ossidati fino a formare un polimero fortemente reticolato tramite legami covalenti — la lignina, il principale costituente del legno.‡

Ma questi sono casi particolari, e la selezione naturale non ha molta "attenzione" da dedicare alla creazione di molti casi del genere.

Non è estraneo alla natura degli atomi di carbonio e altri elementi organici comuni il poter formare strutture robuste. Richiede solo molto più lavoro evolutivo. La selezione naturale non ha il tempo di farlo ovunque, ma solo per alcuni rari casi particolari inseriti nel resto dell'anatomia, come le ossa, la lignina nel legno o la cheratina nelle unghie e negli artigli.

Se utilizzate le parole chiave giuste, potete interrogare, ad esempio, ChatGPT-o1 (nel momento in cui leggerete questo, i modelli linguistici di potenza simile saranno probabilmente gratuiti) e chiedergli informazioni sulla forza dei singoli legami carbonio-carbonio nel diamante, dei legami ferro-ferro nel ferro metallico, dei legami polimerici covalenti nella lignina, dei legami disolfuro nella cheratina o dei legami ionici nelle ossa. Potete chiedergli come tutti questi elementi siano correlati alla resistenza strutturale del materiale più grande. (Nel 2023 non avreste dovuto provarci perché GPT-4 avrebbe sbagliato tutti i calcoli, ma mentre scriviamo questo paragrafo nel 2024, o1 sembra migliore).

Scoprireste che la forza esatta del legame tra due atomi di carbonio è dell'ordine di mezzo attojoule, così come la forza del legame tra due atomi di ferro, e il reticolo solfuro-solfuro nella cheratina è solo leggermente inferiore (0,4 attojoule), così come i legami covalenti polimerizzati nella lignina del legno.

Ma le forze di attrazione statica che ripiegano le proteine sono, a seconda di come le si considera, al massimo dieci volte più deboli e potenzialmente centinaia o migliaia di volte più deboli di quelle.

E anche quando le piante catalizzano sostanze come la lignina, i legami incrociati tendono ad essere più radi dei legami carbonio-carbonio nel diamante. La differenza tra la resistenza in gigaPascal del diamante e quella in megaPascal del legno dipende più dalla densità e dalla regolarità dei legami nel diamante, piuttosto che dalla maggiore resistenza dei singoli legami del diamante.§

A causa dei limiti dell'evoluzione come progettista e dei limiti delle proteine come materiale da costruzione, la vita opera entro vincoli che i progettisti umani e le IA possono aggirare. Gli uccelli sono meraviglie dell'ingegneria, ma i velivoli costruiti dall'uomo possono trasportare carichi diecimila volte più pesanti a una velocità di volo superiore a dieci volte quella degli uccelli più veloci e più forti. I neuroni biologici sono meraviglie dell'ingegneria, ma i transistor costruiti dall'uomo si accendono e si spengono decine di milioni di volte più velocemente dei neuroni più veloci. E la tecnologia di cui disponiamo oggi è ancora solo la punta dell'iceberg di ciò che è possibile realizzare.

Freitas e i globuli rossi

Abbiamo detto che la biologia non è neanche lontanamente vicina al limite di ciò che è fisicamente possibile. Allora, cosa c'è vicino al limite?

Per capire meglio questa domanda, possiamo pensare ai globuli rossi.

Negli ultimi 1,5 miliardi di anni, in tutti gli organismi viventi, dagli esseri umani alle lucertole, nelle forme di vita multicellulari l'ossigeno è stato trasportato dall'emoglobina. L'emoglobina è una proteina composta da 574 aminoacidi, più quattro gruppi eme appositamente creati per contenere una speciale molecola di ferro. Un globulo rosso umano contiene circa 280 milioni di molecole di emoglobina ed è lungo circa sette micron. Tre milioni di essi potrebbero stare sulla testa di uno spillo, e nel vostro corpo ce ne sono circa 30 trilioni.

Quanto si avvicinano i globuli rossi ai limiti teorici di ciò che sarebbe possibile fare, in linea di principio, per trasportare ossigeno?

Rob Freitas, autore di Nanomedicine, nel 1998 ha fatto uno studio abbastanza dettagliato su un progetto teorico per un globulo rosso artificiale usando materiali legati in modo covalente. La cellula era pensata per avere un diametro di un solo micron, così da passare più facilmente nelle arterie intasate.

Invece di limitarsi a pensare a un modo diverso per immagazzinare le molecole di ossigeno, Freitas prese in considerazione la sostituzione completa del globulo rosso. Si basò su analisi precedenti per valutare anche la necessità di estrarre il glucosio dal sangue e convertirlo in energia per alimentare la cellula artificiale. Immaginò sensori delle dimensioni di una cellula e minuscoli computer di bordo composti da aste solide che scattano l’una contro l’altra per eseguire semplici calcoli. Valutò inoltre se la cellula artificiale si sarebbe depositata dalla sospensione nel liquido più rapidamente degli attuali globuli rossi.

La biocompatibilità può essere un problema enorme per qualsiasi cosa che vada all'interno il corpo umano, ma le superfici di diamante sono abbastanza inerti da permettere l'uso di rivestimenti simili al diamante per alcuni dispositivi medici che vanno all'interno il corpo umano. A livello di possibilità teorica, Freitas stava pensando che la superficie della cellula artificiale potesse assomigliare a un diamante e quindi essere biocompatibile.

Fonte immagine:Nanomedicine

Fonte immagine:Nanomedicine

Il fulcro del globulo rosso artificiale era il calcolo di Freitas secondo cui un serbatoio a pressione in corindone o diamante monocristallino, su scala micrometrica, avrebbe potuto sopportare, in modo conservativo, fino a 100.000 atmosfere di pressione. Con un confortevole margine di sicurezza di 100 volte e impacchettando le molecole a “sole” 1.000 atmosfere, i globuli rossi artificiali potrebbero fornire ai tessuti 236 volte più ossigeno per unità di volume rispetto ai globuli rossi naturali, e immagazzinare una quantità simile di anidride carbonica per bilanciare l’altro lato della respirazione. In pratica: potreste trattenere il respiro per quattro ore.

Ora, costruire effettivamente cellule ematiche artificiali di questo tipo è tutta un'altra questione. Ecco perché questo particolare trattamento medico non è ancora disponibile presso l'ambulatorio del vostro medico di base.

Una sfera di diamante solido e perfetto del peso di 1 chilogrammo è una molecola facile da descrivere su carta, ma sintetizzarla è più difficile. Quello che Freitas ci aiuta a fare è formulare ipotesi più informate su quanto la biologia attuale sia lontana dai limiti teorici in questo campo.¶ La biologia è notevole, ma ben lontana dall'ottimale.

È plausibile che, per una serie di ragioni, il progetto esatto di Freitas non funzionerebbe, ed è molto probabile che non sarebbe ottimale. Un'idea iniziale per un progetto complesso estremamente innovativo incontrerà quasi sicuramente dei problemi da qualche parte.

Ma nell'esprimere scetticismo sul fatto che la proposta esatta di Freitas possa funzionare, non stiamo affermando che nessuna alternativa ai globuli rossi possa mai fornire ossigeno centinaia di volte più efficientemente dei globuli rossi biologici.

L'ingegneria consiste nel trovare un modo per far funzionare qualcosa. Anche se mille tentativi di costruire qualcosa falliscono, ne basta uno solo di successo perché l'intero progetto abbia successo. Il fatto che nei secoli XVII e precedenti esistessero innumerevoli progetti di aeromobili irrealizzabili non significava che gli aerei funzionanti fossero impossibili; significava solo che erano difficili da individuare nello spazio di tutti i progetti possibili.

Ecco perché gli scettici della tecnologia, pur avendo spesso ragione sul fatto che le tecnologie sono più lontane nel futuro di quanto credano gli ottimisti più entusiasti, tendono a sbagliarsi quando affermano che certe imprese tecnologiche non saranno mai realizzate. Quando l'impresa è un compito concreto nel mondo reale, quando siamo agnostici su come l'impresa venga realizzata e quando l'impresa è notoriamente consentita dalle leggi della fisica, la storia suggerisce che spesso c'è un modo per riuscirci, anche se inizialmente il percorso non è ovvio.

O, per dirla con le parole dello scrittore e inventore Arthur C. Clarke:

Quando uno scienziato illustre ma anziano afferma che qualcosa è possibile, quasi sicuramente ha ragione. Quando afferma che qualcosa è impossibile, molto probabilmente si sbaglia.

Nanosistemi

Ricapitolando:

- Il mondo biologico è costruito da un'incredibile varietà di macchine molecolari.

- Studiare la biologia può insegnarci quali imprese microscopiche sono possibili dal punto di vista tecnologico.

- Ma la biologia è un limite conservativo su ciò che è possibile; non è vicina ai limiti della possibilità. L'evoluzione è un progettista molto limitato e le proteine non sono il miglior materiale da costruzione.

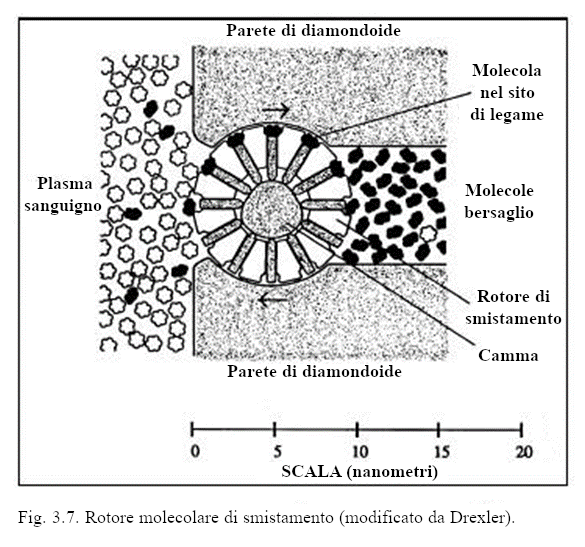

Il libro Nanosystems (1992) di Eric Drexler è un classico che esplora la questione di quali imprese ingegneristiche su piccola scala siano possibili. Nanosystems ha contribuito a dare il via alla rivoluzione dei nanomateriali degli anni '90 e ha suscitato parecchie controversie quando gli scienziati hanno dibattuto le argomentazioni di Drexler. Si può trovare una copia completa online di Nanosystemsqui.

Nanosystems è un testo approfondito e di ampio respiro, ma sorprendentemente accessibile nonostante l'argomento tecnico. Uno dei contributi principali del libro è stato quello di esplorare le implicazioni della costruzione di strutture su piccola scala in modo innovativo.

Un modo per costruire oggetti molto piccoli è attraverso le reazioni chimiche: si fanno scontrare le molecole in particolari condizioni (come il calore estremo) per romperle e far sì che gli atomi si combinino in nuove molecole.

Questo è un approccio potente di per sé ed è il metodo che l'umanità usa per creare materiali come plastica, acciaio e ceramica, ma impallidisce in confronto a ciò che si può costruire con altri metodi. Creare materiali tramite reazioni chimiche è un po' come costruire strutture LEGO riempiendo sacchetti di mattoncini LEGO e scuotendoli con forza. È possibile costruire alcune cose in questo modo, ma l'insieme delle cose che si possono costruire è limitato e c'è molto spreco.

La sintesi proteica è come usare le mani per costruire grandi strutture LEGO a partire da set LEGO più piccoli e precostruiti. C'è spazio per una maggiore precisione perché si può posizionare ogni set precostruito esattamente dove si vuole, ma è comunque un po' strano e scomodo perché si lavora con set precostruiti. Questo è ciò che fanno i ribosomi nel corpo: uniscono catene di amminoacidi per formare proteine, che vengono poi utilizzate per svolgere una varietà di compiti nel corpo.

L'insulina, l'emoglobina e l'ATP sintasi nel corpo umano sono tutti esempi di complessi proteici formati da più catene proteiche unite tra loro: due catene proteiche nel caso dell'insulina, quattro per l'emoglobina e ventinove per l'ATP sintasi.

Gli elementi costitutivi delle proteine (gli amminoacidi) sono molecole composte in genere da dieci a venticinque atomi. Come materiali da costruzione, gli amminoacidi hanno molti vantaggi:

- Ogni amminoacido ha una struttura portante che si collega a una catena laterale (potenzialmente lunga) di atomi di carbonio, idrogeno, ossigeno, azoto e zolfo. Sono possibili centinaia di catene laterali diverse, che si comportano in modi differenti, cosa che rende gli amminoacidi strumenti molto flessibili.

- La struttura portante di un amminoacido, come un pezzo di LEGO, può essere attaccata alla struttura portante di un altro amminoacido. Questo processo può essere ripetuto all'infinito; una proteina tipica è composta da centinaia di amminoacidi attaccati insieme. Ciò rende gli amminoacidi ancora più flessibili come strumenti (o come elementi costitutivi di strumenti). La complessità delle proteine fa anche sì che spesso possano subire piccole modifiche (tramite mutazioni del DNA) senza cambiare radicalmente e diventare completamente inutili — il che a sua volta facilita l'evoluzione di nuove proteine.

- Poiché le proteine sono costituite da catene lineari di amminoacidi, è possibile specificare in modo univoco una proteina semplicemente elencando i suoi amminoacidi in ordine. Il DNA sfrutta questa caratteristica utilizzando un "alfabeto" di quattro lettere (nucleotidi) per formare "parole" di tre lettere (codoni, ciascuno dei quali rappresenta un amminoacido diverso), che possono poi essere concatenate in una "frase" lineare (una proteina costituita da quella esatta sequenza di amminoacidi). (Video esplicativo del DNA.)

- Come dimostrato nell'esperimento di Miller-Urey, gli amminoacidi possono formarsi spontaneamente in assenza di vita, a partire da semplici reazioni chimiche. Questo apre la strada alla comparsa della vita (e dei precursori dei ribosomi e della sintesi proteica).

Gli organismi ottengono la ventina di amminoacidi necessari per la sintesi proteica dal cibo, sintetizzandoli nel corpo o recuperandoli da proteine precedenti. I ribosomi ricevono istruzioni dal DNA che essenzialmente dicono "usa questo amminoacido, poi quest'altro amminoacido, poi quest'altro amminoacido, ..., poi fermati". Gli amminoacidi vengono quindi trasportati (da piccole macchine molecolari chiamate RNA di trasferimento) al ribosoma, che costruisce la proteina pezzo per pezzo.

[embed video or gif: https://www.youtube.com/watch?v=2dV5s6v2v8Q]

È interessante notare che l’elenco sopra comprende caratteristiche estremamente utili per l’evoluzione, ma molto meno necessarie per la progettazione intenzionale. L'evoluzione necessita di una struttura chimica relativamente semplice ma flessibile, che possa essere prodotta da reazioni chimiche comuni. Un progettista umano o artificiale è libero di scegliere tra una varietà di molecole completamente scorrelate, invece di dover utilizzare molecole tutte strettamente correlate tra loro. È anche libero di utilizzare elementi costitutivi che raramente si trovano in natura e di assemblarli in modi complessi, dall'alto verso il basso.

Questo offre in parte la motivazione per esplorare una terza via per costruire oggetti su scala molto ridotta: la meccanosintesi, in cui le strutture vengono assemblate spostando direttamente gli atomi nella posizione corretta, magari utilizzando una macchina simile a un ribosoma che riceve istruzioni e poi assembla strutture molto più varie dei semplici tipi di proteine. Nell'analogia con i LEGO, la meccanosintesi è come poter finalmente lavorare con i singoli pezzi e collocarli esattamente dove si vuole.

Nanosystems esplora quali tipi di nuove macchine potrebbero essere possibili con la meccanosintesi. Un esempio del tipo di progettazione esplorata da Drexler è un ingranaggio planetario ridotto in scala a soli circa 3 500 atomi di dimensione:

[gif: https://chem.beloit.edu/classes/nanotech/nanorex/a8_qm_animation5.gif da https://chem.beloit.edu/classes/nanotech/nanorex/index.html]

L'emoglobina è composta da circa 10.000 atomi, che non è molto lontano dall'ingranaggio di Drexler. E alcune proteine riescono a essere molto più semplici. L'insulina è composta da soli cinquantuno aminoacidi, ovvero circa 800 atomi in totale.

I progetti di Drexler, tuttavia, rappresentano un notevole ridimensionamento rispetto alle macchine più complesse che osserviamo nel corpo. I ribosomi e l'ATP sintasi, per esempio, sono composti da più di 100.000 atomi, e il motore di un flagello batterico ha oltre un milione di atomi.

Nanosystems non tenta ancora di esplorare i limiti di ciò che è tecnologicamente possibile. Ma concentrandosi su casi che sono relativamente facili da analizzare oggi, dimostra che la meccanosintesi permetterebbe una tecnologia che supera quella che vediamo nel mondo biologico odierno.

I calcoli in Nanosystems sono intenzionalmente conservativi. Drexler, per esempio, considera computer costruiti con vere e proprie aste di diamante in movimento — non perché questo fosse il limite finale della tecnologia, ma perché nel 1992 era più facile da analizzare rispetto ai calcoli basati sull'elettricità. Questo, a sua volta, ha contribuito a ispirare l'analisi dei globuli rossi di Freitas. Quattro anni dopo, Eric Drexler e Ralph Merkle (più ampiamente conosciuto come l'inventore dell'hashing crittografico e co-inventore della crittografia a chiave pubblica) hanno tentato di analizzare un sistema leggermente più vicino ai limiti di possibilità per la computazione reversibile, e hanno calcolato 10.000 volte meno calore dissipato per operazione rispetto a quanto Nanosystems aveva stimato — sebbene la nuova stima fosse basata su un'analisi meno attentamente conservativa.

In un'altra parte di Nanosystems, c'è uno schizzo approssimativo per un braccio manipolatore a sei gradi di libertà che avrebbe richiesto milioni di atomi. Un tentativo successivo di progettare una macchina come questa atomo per atomo ha rivelato che ne servivano solo 2 596.

Costruire strutture con precisione atomica alla scala di cui parla Drexler comporta grandi sfide ingegneristiche. Una sfida principale è che ciò richiede manipolatori incredibilmente piccoli e precisi. Tuttavia, l’esistenza dei ribosomi offre una possibile via d’azione.

Mentre i ribosomi possono costruire solo proteine, le proteine possono catalizzare e trascinare reagenti che non sono essi stessi aminoacidi (come ossa e legno). I ribosomi sono fabbriche potenti e generali, e i loro prodotti possono essere usati come punto di partenza per realizzare strumenti più piccoli e precisi, inclusi strumenti che costruiscono più direttamente dispositivi più piccoli usando materiali più resistenti.

Direttamente o indirettamente, è quasi certo che i genomi possano produrre minuscoli attuatori in grado di manipolare singoli atomi per costruire una varietà di strutture non composte da proteine. E, cosa importante, questo non è il tipo di meccanismo in cui la selezione naturale tende a imbattersi, anche se è relativamente facile da costruire, perché il braccio manipolatore non serve a nulla finché non è completo.

L'evoluzione costruisce strutture complesse che sono utili in ogni fase del percorso. Anche molti progetti relativamente semplici sono accessibili agli ingegneri intelligenti, ma non all'evoluzione. Le ruote a rotazione libera, per esempio, sono un'invenzione incredibilmente semplice che ha un'enorme varietà di applicazioni. Nonostante ciò, le ruote a rotazione libera sembrano essersi evolute solo tre volte in tutta la storia della vita sulla Terra: nell'ATP sintasi e nel flagello batterico di cui abbiamo discusso prima, e nel flagello archeale, che sembra essersi evoluto indipendentemente.‖

Nonostante i metodi conservativi utilizzati nel libro, il limite inferiore tecnologico stabilito da Nanosystems è molto alto in termini assoluti. Una superintelligenza con il tipo di tecnologia che Drexler descrive sarebbe in grado di produrre minuscole fabbriche autoreplicanti simili a ribosomi la cui popolazione raddoppia ogni ora — alcuni organismi si replicano anche più velocemente, ma Drexler ha fatto calcoli conservativi — e che possono raggrupparsi per costruire strutture macroscopiche più grandi, come le centrali elettriche.

I nanosistemi come quelli descritti da Drexler possono riprodursi da soli usando la luce del sole e l'aria come materie prime, cosa che permette loro di espandersi molto rapidamente e in modo affidabile. Il motivo per cui questo può funzionare è lo stesso per cui gli alberi riescono a creare materiali da costruzione in grande quantità praticamente dal nulla, estraendo carbonio dall'aria e immagazzinandolo sotto forma di legno. Anche se pensiamo all'aria come a uno "spazio vuoto", il carbonio, l'idrogeno, l'ossigeno e l'azoto presenti nell'aria sono materiali da costruzione che possono essere riorganizzati in materiali solidi e utilizzati per una vasta gamma di scopi.

I replicatori auto-assemblanti in stile Nanosystems, fatti di materiali come ferro o diamante invece che proteine, potrebbero attraversare le cellule biologiche più o meno come un tosaerba taglia l'erba.

Potrebbero sintetizzare a basso costo qualcosa come la tossina botulinica, la proteina responsabile del botulismo. Un milionesimo di grammo di tossina botulinica — ventimila volte più piccolo di un singolo chicco di riso — è una dose letale. Replicatori progettati con cura potrebbero propagarsi im maniera invisibile nell'aria aperta fino a quando almeno uno di essi non fosse stato probabilmente inalato da quasi tutti gli esseri umani (che non avessero, ad esempio, trascorso tutto l'ultimo mese in un sottomarino); a quel punto, i dispositivi potrebbero (tramite un timer) rilasciare simultaneamente una piccola dose di tossina, uccidendo immediatamente e simultaneamente quasi tutti gli esseri umani.

Oppure i nanosistemi costruiti dall'intelligenza artificiale potrebbero spazzare via gli esseri umani in modo accidentale, nel corso della raccolta e del riutilizzo delle risorse della Terra. Un articolo di Freitas calcola che macchine di micro-diametro, che usano solo la luce solare come fonte di energia e l'idrogeno, il carbonio, l'ossigeno e l'azoto dell'aria come materie prime, potrebbero essere progettate per riprodursi così velocemente da oscurare il cielo in meno di tre giorni, consumando anche l'intera biosfera.# Di conseguenza, se la prima IA a raggiungere una tecnologia di questo tipo avesse un anticipo di pochi mesi, potrebbe plausibilmente utilizzare tale tempo per distruggere tutti i concorrenti (sia umani che IA). Si tratta di una tecnologia che conferisce un vantaggio strategico permanente e decisivo al primo che la utilizza.

Dire che la nanotecnologia drexleriana è realizzabile in linea di principio non significa necessariamente che le prime IA più intelligenti degli umani potrebbero davvero costruire una tecnologia che si avvicini a quei limiti fisici. La nostra ipotesi migliore è che rientri nell'ambito delle cose che una superintelligenza artificiale potrebbe capire, perché capire questo tipo di compiti ingegneristici sembra soprattutto una sfida cognitiva (che può essere risolta con il pensiero) e non ci aspettiamo che la fase di sperimentazione e test debba essere così lunga.

Anche se la nostra ipotesi fosse corretta, non c'è alcuna garanzia che la prima mossa di una superintelligenza consisterebbe nell'utilizzare la nanotecnologia per costruire una sua infrastruttura e prendere il controllo delle risorse mondiali. Per quanto ne sappiamo, potrebbe sviluppare tecniche e tecnologie che le consentano di raggiungere i suoi obiettivi in modo ancora più rapido ed efficiente.

Ma se un'intelligenza artificiale più intelligente dell'uomo fosse davvero in grado di costruire sistemi che sono per le cellule ciò che gli aerei sono per gli uccelli e di diffondere la propria infrastruttura su tutta la superficie terrestre, allora qualsiasi cosa finisse per fare sarebbe almeno altrettanto decisiva.

Il punto di tutta questa analisi è sostenere che la tecnologia umana è ben lontana dai limiti del possibile. Esiste un'ampia varietà di tecnologie importanti che probabilmente richiederebbero all'umanità decenni, secoli o millenni per essere comprese, e che le superintelligenze artificiali sarebbero in grado di realizzare rapidamente.

In breve, la nanotecnologia dimostra che una superintelligenza con un po' di tempo a disposizione potrebbe probabilmente trovare soluzioni tecnologiche per conquistare il pianeta.

L'esito più probabile della creazione di una superintelligenza è che questa scopra una tecnologia almeno potente quanto la nanotecnologia, e quindi l'umanità semplicemente perda.

Questa ipotesi non è cruciale per l'argomentazione che sviluppiamo nel libro. L'umanità perderebbe contro una superintelligenza anche se nel mondo non esistesse ancora una tecnologia che garantisca una "vittoria immediata" come la nanotecnologia. Quindi non approfondiamo questa analisi nel corpo principale del libro.

Nella Parte II, ci concentriamo deliberatamente su uno scenario di conquista che non presuppone che l'IA abbia una capacità generale di produzione atomicamente precisa, sia tramite ribosomi che tramite meccanosintesi. Una superintelligenza non ha bisogno di un vantaggio tecnologico assolutamente schiacciante per conquistare il controllo del futuro, quindi non ci soffermiamo troppo su questa possibilità nel libro.

Ma vale anche la pena sottolineare che probabilmente avrà un vantaggio tecnologico assolutamente schiacciante.

* Forse l'esempio più evidente è quello dei computer, con una teoria sostanziale elaborata da personaggi come Charles Babbage, Ada Lovelace, Alan Turing, Alonzo Church e altri.

† Il capitolo 15 di Nanosystems di Eric Drexler raccoglie altri esempi di tecnologie con analogie nel mondo biologico.

‡ Anche all'interno delle proteine, alcuni legami covalenti sono possibili. Due aminoacidi cisteina possono formare un legame covalente zolfo-zolfo tra loro, dove due proteine si toccano o dove una proteina ripiegata tocca se stessa. È così che le unghie riescono ad essere più dure della pelle, o che i capelli sono più resistenti rispetto ai muscoli dello stesso diametro e lunghezza: molti legami zolfo-zolfo in una proteina che è composta per il 14% in massa da cisteina. Questo è anche il motivo per cui i capelli hanno un odore sgradevole e sulfureo quando vengono bruciati.

§ Il diamante è anche più fragile. L'estrema regolarità cristallina dei legami del diamante fa sì che si rompa tutto in una volta. Il ferro è meno fragile perché ogni enorme nucleo di ferro vive in una nuvola di elettroni e può essere spostato all'interno di quella nuvola senza rompersi.

¶ Anche se Freitas doveva fare i conti con un problema in più, cioè che i suoi globuli rossi artificiali dovevano funzionare bene con il resto dei sistemi del corpo umano. La cellula avrebbe dovuto usare il glucosio presente nel sangue, per esempio, invece di ricaricarsi con l'elettricità. In questo senso, le stime di Freitas sono più conservative rispetto a quelle che avrebbe potuto fare se avesse potuto migliorare anche altre parti del corpo umano o partire da zero con un nuovo organismo o un robot.

‖ Online potete leggere lunghe analisi sul perché non sarebbe utile per la biologia inventare ruote che girano liberamente. Un esempio di un problema comune è: come si fa a usare i vasi sanguigni per mandare il sangue alla ruota se questa gira liberamente? I vasi sanguigni finirebbero per attorcigliarsi quando la ruota si muove!

# All'epoca, Freitas interpretò i suoi numeri come un limite massimo alla velocità con cui questo processo poteva avvenire, ma questo si rivelò errato. L'analisi di Freitas aveva ipotizzato che la massa dei nanosistemi sarebbe stata dominata dalla schermatura dalle radiazioni, ma questo si basava su un presupposto (errato) in Nanosystems: che un singolo impulso di radiazioni avrebbe distrutto un nanosistema.

Notes

[1] più tempo del necessario: Il nervo laringeo ricorrente della giraffa prende la strada panoramica per arrivare al cervello. Invece, il nervo laringeo superiore della giraffa prende la strada diretta ed è quindi piuttosto piccolo e veloce.

[2] molto più lentamente: La più antica prova definitiva di vita sotto forma di microfossili risale a 3,5 miliardi di anni fa, mentre prove più indirette indicano un'età più vicina ai 4 miliardi di anni. Le prime colonie multicellulari sembrano avere 2 miliardi di anni. La maggior parte della storia evolutiva è stata dedicata alla creazione di organismi unicellulari e poi di organismi unicellulari aggregativi, prima di imbattersi accidentalmente — l'evoluzione non prevede nulla — in qualche nuovo trucco che ha aperto la regione dello spazio di progettazione della "vita multicellulare", contenente tutte le piante e tutti gli animali.

[3] probabilità che la mutazione si diffonda: Se il vantaggio di idoneità di una mutazione è s << 1 e la dimensione della popolazione è N, allora la probabilità che la mutazione si diffonda in tutta la popolazione (chiamata "fissazione") è circa 2s, e il tempo necessario affinché la mutazione si diffonda completamente è circa 2 ln(N) / s.