¿No serán las empresas más imprudentes, naturalmente, las más incompetentes y, por lo tanto, no supondrán una amenaza?

No, en general. Tomar atajos suele ser competitivo.

Los esfuerzos de Volkswagen por hacer trampa en las pruebas de emisiones entre 2008 y 2015 fueron audaces y, al parecer, eficaces. Los accidentes del Boeing 737 MAX en 2018 y 2019, atribuidos a fallos en un sistema de control de vuelo que la dirección conocía y cuya importancia minimizó, se cobraron la vida de 346 personas. Pero los sectores automotriz y aeronáutico son industrias altamente competitivas en las que Volkswagen y Boeing eran, y siguen siendo, gigantes.

No nos parece un gran misterio que quienes toman atajos sean competitivos. En ambos casos, el comportamiento parece haber estado impulsado por la presión de sacar al mercado productos de alto rendimiento más baratos y antes que la competencia. Incluso ahora, tras los enormes acuerdos extrajudiciales y el daño a la marca, no es evidente que las empresas sean menos competitivas por tener culturas corporativas que fomentan el astuto uso de atajos, aunque esto ocasionalmente signifique ser descubiertas.

Si crees que las principales empresas de IA son la excepción a esta regla, considera el siguiente titular (y subtítulo) de julio de 2025:

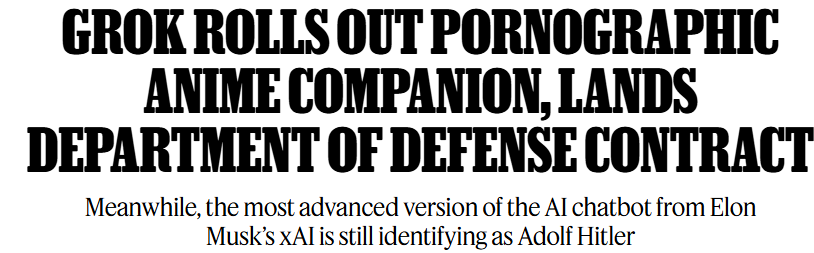

Título: «Grok lanza una compañera de anime pornográfica y obtiene un contrato con el Departamento de Defensa». Subtítulo: «Mientras tanto, la versión más avanzada del chatbot de xAI, de Elon Musk, sigue identificándose como Adolf Hitler».

Título: «Grok lanza una compañera de anime pornográfica y obtiene un contrato con el Departamento de Defensa». Subtítulo: «Mientras tanto, la versión más avanzada del chatbot de xAI, de Elon Musk, sigue identificándose como Adolf Hitler».

No creemos que sea técnicamente posible que ningún equipo que utilice algo remotamente parecido a los métodos modernos construya una superinteligencia sin provocar una catástrofe. Pero incluso si esto fuera remotamente posible con la tecnología actual, parece casi inevitable que una empresa de IA igualmente metiera la pata y acabara matándonos a todos, dado el nivel de competencia y seriedad que vemos hoy en día.

Las empresas más cautelosas de hoy siguen siendo imprudentes.

Muchas personas consideran que la empresa de IA Anthropic es líder en «seguridad de la IA», ya que ha sido pionera en iniciativas como los compromisos voluntarios de seguridad. Pero incluso ellos modifican sus compromisos voluntarios en el último momento cuando se dan cuenta de que no pueden cumplirlos, y los «planes» que tienen son vagos y están mal pensados, como se critica en el capítulo 11 y en el debate ampliado más abajo.

Anthropic se beneficia enormemente del hecho de que los observadores miden con distinta vara: en una industria normal, una empresa que decide poner en peligro la vida de miles de millones de personas (como admite el director general) y que, al mismo tiempo, minimiza sistemáticamente sus actividades ante el público y los legisladores,* no recibiría elogios por su moderación.

Tomar atajos es habitual en la IA, al igual que en muchos sectores competitivos. La imprudencia es habitual. Y es muy evidente que las empresas menos imprudentes no están a la altura de los retos.

* Por ejemplo, en un testimonio ante el Congreso:

Notes

[1] al público: Por ejemplo, en Machines of Loving Grace, el director general de Anthropic, Dario Amodei, describe la IA potente como «un país de genios en un centro de datos» y destaca una serie de maravillosos beneficios para la salud, la riqueza, la paz y el sentido que esas mentes podrían aportar a la humanidad. Concluye lo siguiente: